Tech

ByteDance enthüllt Astra: Ein revolutionäres Dual-Modell-Framework für selbstnavigierende Roboter

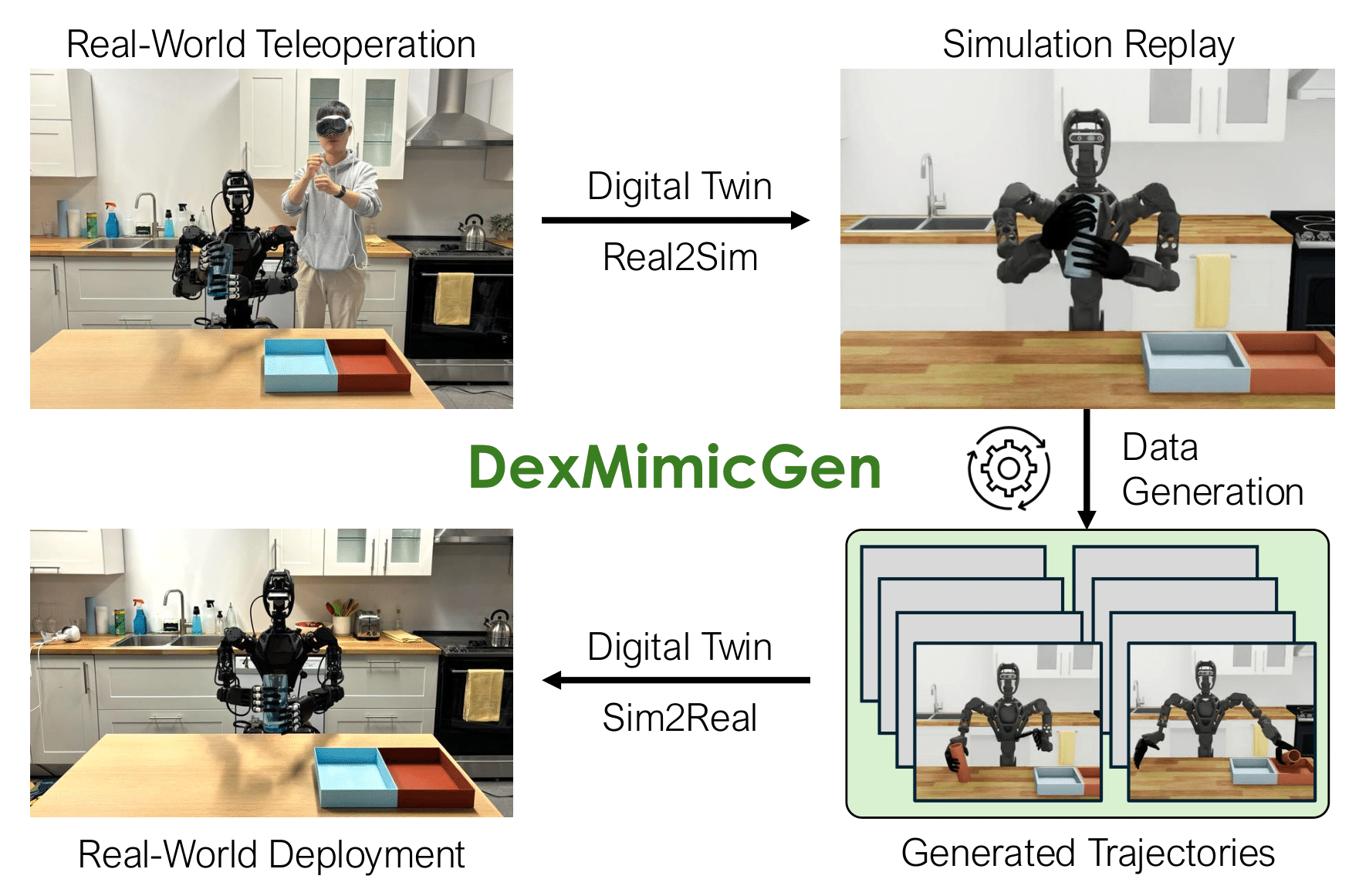

Roboter verlassen Labore und betreten Häuser, Krankenhäuser und Lagerhäuser, doch die Navigation in überfüllten, sich wiederholenden und sich verändernden Innenräumen bereitet ihnen weiterhin Probleme. ByteDance’s Astra schlägt einen Dual-Modell-Ansatz vor, der „Denken“ und „Reagieren“ in zwei koordinierte Gehirne aufteilt. Das Ergebnis ist ein System, das Bilder und Sprache liest, eine semantisch reichhaltige globale Karte erstellt und sichere Bahnen in Echtzeit plant.

Hier ist eine klare Übersicht dessen, was sich für Teams, die heute mobile Roboter einsetzen, ändert.

Eilig? Das ist wichtig:

| Wichtige Punkte ⚡ |

|---|

| 🧭 Duales Modell: Astra-Global übernimmt Selbst-/Ziel-Lokalisierung; Astra-Local plant sichere, Echtzeit-Bewegungen. |

| 🗺️ Hybride Karte: Ein topologisch-semantischer Graph verbindet Orte und Wahrzeichen, wodurch robuste visuell-sprachliche Abfragen ermöglicht werden. |

| 🚧 Sicherere Planung: Ein maskierter ESDF-Verlust reduziert Kollisionen im Vergleich zu Diffusions- und Imitations-Baselines. |

| 🔌 Ökosystem-Kompatibilität: Entwickelt für die Zusammenarbeit mit NVIDIA Edge Stacks, ROS2 und Robotern führender Hersteller wie Boston Dynamics und Fetch Robotics. |

Wie Astras Dual-Modell-Architektur die Fragen „Wo bin ich? Wo gehe ich hin? Wie komme ich dahin?“ beantwortet

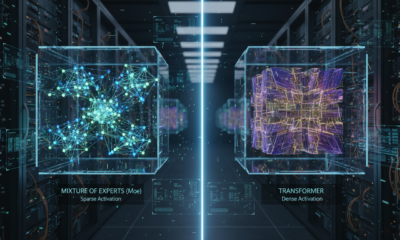

Moderne Flotten in Einrichtungen wie „MetroCart Logistics“ stehen vor drei wiederkehrenden Fragen: Selbstlokalisierung, Ziellokalisierung und lokale Bewegung. Traditionelle Pipelines verketten kleine Module oder Regeln, die in sich ähnelnden Korridoren oder bei Anweisungen in natürlicher Sprache Schwierigkeiten haben. ByteDance’s Astra definiert die Architektur neu als zwei kooperierende Modelle: Astra-Global (niedrige Frequenz, hochstufiges Denken) und Astra-Local (hohe Frequenz, Nahbereichskontrolle).

Diese Aufteilung folgt einem System-1/System-2-Muster. Das globale Modell verarbeitet Bilder und Sprache, um den Roboter auf einer Karte zu verorten und Ziele wie „Lieferung zur Krankenstation nahe der Radiologie“ zu interpretieren. Das lokale Modell plant und plant Trajektorien auf Steuerfrequenz neu, kombiniert Sensoren, um Hindernissen wie Wagen, Menschen oder temporären Barrieren auszuweichen. Zusammen reduzieren sie die langanhaltenden fehleranfälligen Verhaltensweisen, die konventionelle Systeme in Büros, Einkaufszentren und Wohnungen plagen.

Von brüchigen Modulen zu zwei koordinierten Gehirnen

Anstatt ein halbes Dutzend kleiner Modelle zu tunen, komprimiert Astra Fähigkeiten in zwei robuste Netzwerke. Die globale Komponente reduziert Ambiguität, indem sie Ziele an semantische Wahrzeichen ankert, während die lokale Komponente Bewegungen sicher und glatt hält, selbst wenn die Karte teilweise falsch ist. Wenn ein Flur blockiert ist, passt sich Astra-Local an; wenn ein Ziel nur textuell beschrieben wird, übersetzt Astra-Global Wörter in Kartenkoordinaten.

- 🧩 Modulare Klarheit: globale Logik bleibt stabil; lokale Steuerung bleibt agil.

- 🗣️ Sprachverankerung: Aufgaben in natürlicher Sprache funktionieren ohne manuelle Wegpunkte.

- 🛡️ Risikoreduzierung: weniger Regelkonflikte und weniger Überanpassung an einzelne Gebäude.

- ⚙️ Wartbarkeit: Updates betreffen zwei Modelle statt vieler brüchiger Skripte.

Was sich im Tagesgeschäft ändert

In einem Krankenhaus kann eine Krankenschwester sagen „Hole Vorräte aus dem Lagerraum neben ICU-3“, und das globale Modell verbindet diesen Ausdruck mit einem semantisch kartierten Knoten. In einem Lager meistert Astra-Local Ausweichmanöver um Paletten in Echtzeit und bleibt dabei auf einem kollisionsminimierten Pfad. Über eine gesamte Flotte reduziert das menschliche Eingriffe und hilft Planern, den Durchsatz genauer vorherzusagen.

| Aufgabe 🔍 | Bearbeitet von 🧠 | Frequenz ⏱️ | Beispiel 🧪 | Ergebnis ✅ |

|---|---|---|---|---|

| Selbstlokalisierung | Astra-Global | Niedrig | Identifikation des aktuellen Korridors mithilfe von Kamerabildern | Stabile Position in sich wiederholenden Layouts 🧭 |

| Ziellokalisierung | Astra-Global | Niedrig | „Gehe zum Ruhebereich“ als Text | Ziel an semantischem Knoten fixiert 🎯 |

| Lokale Planung | Astra-Local | Hoch | Erzeugung einer Trajektorie um einen Wagen | Niedrigere Kollisionsrate 🚧 |

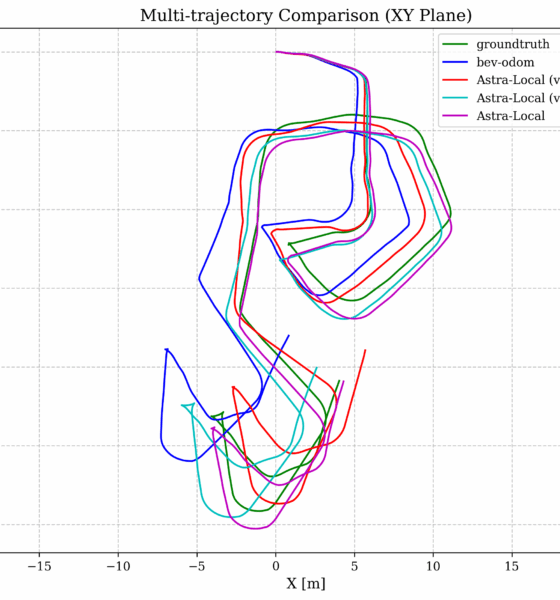

| Odometrienschätzung | Astra-Local | Hoch | Fusion von IMU + Rädern + Vision | ~2% Trajektorienfehler 📉 |

Erkenntnis: Die Trennung globaler Logik von lokalen Reflexen beseitigt den zentralen Spannungsbogen, der herkömmliche Pipelines bei Veränderungen anfällig macht.

Blick ins Astra-Global: Multimodale Lokalisierung mit einer hybriden topologisch-semantischen Karte

Astra-Global ist ein multimodales Modell, das Bilder und Sprache aufnimmt, um sowohl die aktuelle Position des Roboters als auch das Ziel zu bestimmen. Sein Kontext ist ein offline gebauter hybrider Graph: Knoten als Schlüsselbilder (mit 6-DoF-Positionen), Kanten, die Konnektivität kodieren, und Wahrzeichen mit semantischen Attributen wie „Empfangstresen“ oder „Aufzugsschacht“. Diese Karte gibt dem Modell einen Skelettaufbau, wo man sich bewegen kann, und die Bedeutung der Orte.

Wie der Graph aufgebaut und verwendet wird

Die Mapping-Pipeline reduziert Videos auf Schlüsselbilder, schätzt Kamerapositionen mit SfM und konstruiert einen Graph G=(V,E,L). Wahrzeichen werden pro Knoten vom Modell extrahiert und über Ko-Sichtbarkeit verbunden, was Redundanz schafft, die in ähnlich aussehenden Korridoren hilft. Im Betrieb läuft das Modell ein grob-zu-fein Verfahren: Zuerst werden Kandidaten-Wahrzeichen und Regionen abgeglichen; dann wählt die Feinschätzung einen präzisen Knoten aus und gibt die Position aus.

- 🧱 Knoten (V): zeitlich abgetastete Schlüsselbilder mit 6-DoF-Posen.

- 🔗 Kanten (E): ungerichtete Verbindungen, die globale Routenoptionen unterstützen.

- 🏷️ Wahrzeichen (L): semantische Anker wie „ICU-3 Schild“ oder „Ladetors Tür“.

Für sprachbasierte Ziele parst Astra-Global Texte wie „nächste Ladestation am Westausgang“, identifiziert relevante Wahrzeichen nach Funktion (Ladestation, Ausgangsbeschilderung) und löst dann auf das beste Knoten-Bild-Paar mit Position auf.

Trainingsrezept: SFT + GRPO für Zero-Shot-Stärke

Auf einem Qwen2.5-VL-Backbone aufgebaut, wird Astra-Global zuerst mit überwachtem Feintuning (grobe/feine Lokalisierung, Ko-Sichtbarkeit, Bewegungstrend) trainiert und danach mit Group Relative Policy Optimization unter Verwendung regelbasierter Belohnungen weiter optimiert. Diese zweite Phase erzwingt das Antwortformat, die korrekte Wiederherstellung der Wahrzeichen und das richtige Knoten-Karten-Matching. Das Ergebnis ist eine starke Zero-Shot-Generalisation mit ~99,9 % Lokalisierungsgenauigkeit in unbekannten Häusern laut interner Bewertungen.

- 🎓 SFT: vielfältige Aufgaben stabilisieren Ausgaben und lehren das Format.

- 🏆 GRPO: Belohnungsformung sichert konsistente visuell-sprachliche Verankerung.

- 🧭 Robustheit: bewahrt Genauigkeit bei Blickwinkelverschiebungen und nahezu gleichen Szenen.

| Komponente 🧩 | Rolle 🧭 | Datenquelle 📷 | Warum es wichtig ist ⭐ |

|---|---|---|---|

| Hybrider Graph (V,E,L) | Kontext für Logik | Video-Schlüsselbilder + SfM + Wahrzeichen | Kombiniert „wo“ und „was“ 🗺️ |

| Grob-zu-fein-Abgleich | Schnelles Ausschließen von Kandidaten | Abfragebild + Prompt | Effizient und präzise 🎯 |

| Sprachverankerung | Text auf Knoten abbilden | Natürliche Anweisungen | Menschengerechte Aufgabenverteilung 🗣️ |

| SFT + GRPO | Policy-Verfeinerung | Gemischte Datensätze | Bessere Zero-Shot-Leistung 📈 |

Für Teams, die Alternativen von OpenAI</strong-ähnlichem Instruktions-Folgen bis zu klassischen VPR evaluieren, ist dieser hybride Graph plus Verstärkungs-Tuning der Schlüsselunterschied in mehrdeutigen Innenräumen.

Erkenntnis: Semantische Wahrzeichen verwandeln ähnlich aussehende Flure in eindeutige Adressen, auf die ein sprachfähiges Modell verlässlich verweisen kann.

Blick ins Astra-Local: 4D raum-zeitliche Wahrnehmung, sicherere Planung und genaue Odometrie

Wo Astra-Global entscheidet „wo“, entscheidet Astra-Local „wie“. Es ersetzt mehrstufige Wahrnehmungs-Stacks durch einen 4D raum-zeitlichen Encoder, der omnidirektionale Bilder in zukunftsbewusste Voxel-Features transformiert. Darauf sitzt ein Planungs-Kopf, der Trajektorien mit Transformer-basiertem Flussabgleich erzeugt, und ein Odometrie-Kopf, der Bilder, IMU- und Rad-Daten fusioniert, um Drift zu minimieren.

4D Encoder: Jetzt sehen und das Nächste antizipieren

Astra-Local beginnt mit einem 3D-Encoder: Vision Transformers verarbeiten mehrere Kameraperspektiven, und Lift-Splat-Shoot wandelt 2D-Features in Voxel-Raum um. Ein differenzierbarer neuronaler Renderer überwacht die Geometrie. Dann sagt ein zeitlicher Stapel (ResNet + DiT) zukünftige Voxel-Features voraus, wodurch der Planer Kontext zu beweglichen Hindernissen und wahrscheinlichen freien Räumen erhält.

- 📦 Omnidirektionaler Input: weniger tote Winkel bei Nahbereichsgefahren.

- ⏩ Zukünftige Voxel-Prognose: vorausschauende Planung statt rein reaktiver Bewegung.

- 🧰 Selbstüberwachte Geometrie: reduziert Abhängigkeit von dichten Labels.

Planung: Flussabgleich mit kollisionsbewussten Verlusten

Der Planer nutzt die 4D-Features, die Geschwindigkeit des Roboters und Hinweisangaben zur Ausgabe einer glatten, machbaren Trajektorie. Ein maskierter ESDF-Verlust bestraft die Nähe zu Hindernissen mithilfe einer 3D-Belegungs-Karte und einer 2D-Ground-Truth-Maske, eine Kombination, die sich in Tests außerhalb der Verteilung als wirksamer bei der Verringerung von Kollisionen gegenüber ACT- und Diffusions-Policy-Baselines erwiesen hat.

- 🛡️ Maskierter ESDF: intelligentere Abstandsstrafe verringert knappe Berührungen.

- 🧮 Transformer-Flussabgleich: effizientes Abtasten von Trajektorien unter Unsicherheit.

- 🚀 OOD-Resilienz: bessere Übertragbarkeit auf neue Gebäude und Layouts.

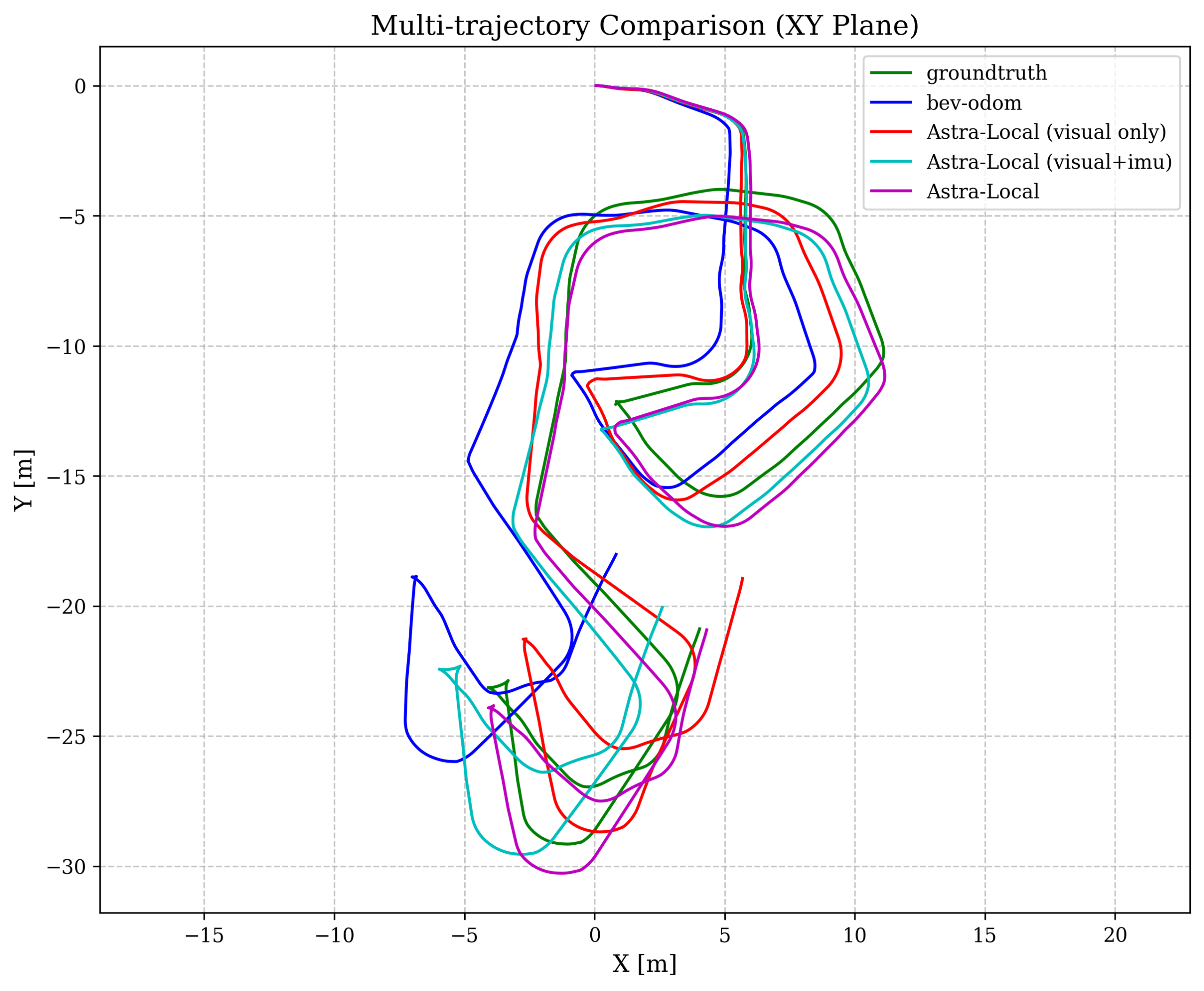

Odometrie: Multi-Sensor-Fusion, die Maßstab und Drehung hält

Die Pose-Schätzung verwendet Tokenizer für jeden Sensorstrom, Modality-Embeddings und einen Transformer-Encoder, der mit einem CLS-Token für relative Pose endet. Die Fusion von IMU-Daten verbessert die Rotationsgenauigkeit drastisch, während Raddaten den Maßstab stabilisieren und den Trajektorienfehler in gemischten Innenraum-Sequenzen auf ~2 % reduzieren.

| Modul ⚙️ | Eingänge 🎥 | Ausgänge 🧭 | Ziel 🎯 | Nutzen ✅ |

|---|---|---|---|---|

| 4D Encoder | Multi-Kamera-Bilder | Aktuelle + zukünftige Voxel | Zeitliche Vorhersage | Antizipiert Bewegung ⏳ |

| Planungskopf | 4D-Features + Geschwindigkeit | Trajektorie | Maskierter ESDF + Flussabgleich | Weniger Kollisionen 🚧 |

| Odometrie-Kopf | Bilder + IMU + Räder | Relative Pose | Transformer-Fusion | ~2 % Drift 📉 |

- 🧪 Beispiel: Ein Roboter im Café „Leaf & Latte“ schlängelt sich zur Rushhour zwischen Stühlen hindurch, ohne Rückwärtsstöße.

- 🧭 In engen Lagerräumen verhindert Drehungsgenauigkeit die Aufsummierung von Drift bei engen Kurven.

- 🧰 Wartbar: Ein Encoder ersetzt mehrere Wahrnehmungsmodule.

Erkenntnis: Die Kombination aus 4D-Encoder und ESDF-Verlust verschiebt die Planung in einen prädiktiven Modus und senkt das Risiko dort, wo Menschen unterwegs sind und arbeiten.

Erfahrungen aus Lagerhäusern, Büros und Wohnungen: Kennzahlen, Fehlerszenarien und Korrekturen

Die Bewertungen umfassen Lagerhäuser, Büros und Wohnungen – Räume mit sich wiederholenden Texturen, Möbelumstellungen und häufigen Sichtbehinderungen. Bei der Lokalisierung übertrifft Astra-Global traditionelle visuelle Ortsbestimmung durch die Nutzung semantischer Wahrzeichen und räumlicher Beziehungen; bei der Planung reduziert Astra-Local Kollisionen und verbessert Gesamtwerte gegenüber ACT- und Diffusions-Policies bei Layouts außerhalb der Verteilung.

Was die Zahlen auf dem Boden bedeuten

In einem Testgang bei MetroCart Logistics sind Raumzahlen und Beschilderung kleine, aber entscheidende Hinweise. Wo globale Feature-basierte VPR ähnliche Korridore falsch zuordnet, erkennt Astra-Global feinkörnige Wahrzeichen und hält die Pose-Fehler unter ~1 m und 5°. In einem Heimtest lösen Textanfragen wie „Wo ist der Ruhebereich“ die richtigen Bilder und 6-DoF-Positionen auf, was natürliche sprachgesteuerte Aufgaben unterstützt.

- 🧩 Detailerfassung: Wahrzeichen-Level-Features verringern Fehlzuordnungen in sich wiederholenden Fluren.

- 🔄 Blickwinkelrobustheit: stabil bei großen Winkeländerungen, die VPR stören.

- 🧭 Positionsgenauigkeit: bessere Anpassung an Knoten-Wahrzeichen-Geometrie, verbessert Routenauswahl.

Bei der Planung ist ein Krankenhausflur in „St. Aurora“ ein bewegtes Feld aus Betten und Wagen. Der maskierte ESDF-Verlust von Astra-Local führt zu weniger nahen Wandpassagen und gleichmäßigeren Geschwindigkeiten, was Krankenschwesternbeschwerden und fast-Kollisionen reduziert. In einer Wohn-Demo schlingert das System weniger in Spielzeug und Stühlen, zeigt weniger Sackgassen und geringere Oszillation an Türschwellen.

| Szenario 🏢 | Messgröße 📏 | Astra ⚡ | Baseline 🧪 | Delta 📈 |

|---|---|---|---|---|

| Lagerhausflur | Pesenfehler | ≤1 m / 5° | höherer Drift | Bessere Lokalisierung 🧭 |

| OOD Büro-Layout | Kollisionsrate | Niedriger | ACT / Diffusion | Weniger Kontakte 🚧 |

| Wohnräume | Text-zu-Ziel | Zuverlässig | Unzuverlässig | Schnellerer Aufgabenstart 🗣️ |

| Krankenhausflur | Geschwindigkeitsstabilität | Gleichmäßiger | Ruckelig | Komfortsteigerung 🧑⚕️ |

- 🛠️ Beobachteter Fehler: Feature-arme Korridore können Einzelbild-Lokalisierung verwirren – zeitliches Denken ist geplant.

- 🧭 Beobachteter Fehler: Starke Kartenkompression kann wichtige Semantiken verlieren – alternative Komprimierungsmethoden sind vorgesehen.

- 🔁 Robustheitsplan: Integration aktiver Erkundung und intelligenterer Fallback-Wechsel bei Unsicherheiten.

Erkenntnis: Starke Ergebnisse entstehen durch die Kombination semantischen globalen Kontexts mit vorausschauender lokaler Steuerung – nicht durch Aufblähung einzelner Module.

Rollout-Plan für 2025: Hardware, Integration, Sicherheit und Branchentauglichkeit

Der Rollout von Astra bedeutet, die Modelle mit bereits vertrauter Hardware und Sicherheitspraktiken in Robotik-Teams zu koppeln. Bei der Rechenleistung sind NVIDIA Jetson-Klassen-Edge-Module eine natürliche Wahl für Multi-Kamera-Pipelines, während diskrete GPUs auf mobilen Basen Spitzenbelastungen in größeren Einrichtungen bewältigen. Die Integration erfolgt über ROS2, wobei Astra-Global als Lokalisierungs-/Zielservice und Astra-Local als Planer- und Odometrie-Knoten angeboten wird.

Ökosystem- und Anbieterlandschaft

Plattformanbieter positionieren sich unterschiedlich. Boston Dynamics könnte Astra-Global für hochstufige Zielverankerung bei Spot-ähnlichen Robotern nutzen, während Flotten von Fetch Robotics Astra-Local einsetzen, um in Gängen um Paletten sicherer zu werden. ABB Robotics und Honda Robotics können mobile Manipulatoren mit semantisch verankerten Zielen verbinden. Für Verbraucher- und Serviceroboter bieten iRobot und Samsung Robotics eine zuverlässigere Raumnamensgebung und Wegfindung in unübersichtlichen Umgebungen.

- 🤝 ROS2-orientiert: Themen- und Service-Schnittstellen machen Integration berechenbar.

- 🧠 Instruktionsverfolgung: Kombination von Astra-Global mit LLM-Stapeln von OpenAI für reichhaltigere Aufgaben, Astra-Local führt sicher aus.

- 🧩 Sensoren: Multi-Kamera + IMU + Raddrehzahler sind ideal für die Fusion von Astra-Local.

Sicherheit, Datenschutz und Wartbarkeit

Sicherheit beruht auf mehrschichtigen Kontrollen: zertifizierte Notausschalter, Geschwindigkeitsbegrenzungen in der Nähe von Menschen und vertrauensbasierte Übergabe an einfache Fallback-Controller. Datenschutz wird durch Geräte-Processing und verschlüsselte Kartenlagerung gewährleistet. Die Wartbarkeit verbessert sich, da Updates nur zwei Kernmodelle betreffen statt vieler kleiner Module, und Flotten-Telemetrie fokussiert auf Vertrauenswerte und Kollisionsabstände.

| Branche 🏭 | Robotertyp 🤖 | Aufgaben 📦 | Hardware-Stack 🧱 | Integration 🔌 | Auswirkung 💥 |

|---|---|---|---|---|---|

| Lagerhäuser | AMRs (z. B. Fetch Robotics) | Palettenbewegung; Gangpatrouille | NVIDIA Jetson + Multi-Kamera | ROS2 + Astra-Local | Weniger Kollisionen 🚧 |

| Krankenhäuser | Servicebasen | Versorgungsfahrten; Lieferung | Edge-GPU + Tiefenkameras | Astra-Global-Ziele | Natürliche Sprachaufgaben 🗣️ |

| Einzelhandel | Inventurwagen | Nachfüllen; Führung | IMU + Räder + RGB | LLM + Astra-Fusion | Geschmeidigere Wege 🛒 |

| Wohnungen | Service-Bots (iRobot, Samsung Robotics) | Raumspezifische Aufgaben | Kompaktes SoC + Kameras | On-Device-Karten | Weniger Drift 🧭 |

| Bau | Beinroboter (Boston Dynamics) | Inspektion; Lieferung | Diskrete GPU | Semantische Ziele | Bessere Standfestigkeit 🔩 |

- 🪜 Klein anfangen: Piloten auf einer Etage mit Astra-Global-Mapping und Astra-Local-Planung.

- 🧪 Sicherheit validieren: Maskierte ESDF-Abstände mit gestuften Hindernissen und Dummy-Zuschauern testen.

- 📈 Skalieren: Zuerst Nachtschichten, dann Mischverkehrszeiten bei stabiler Sicherheit.

Roadmap-Punkte – OOD-Robustheit, engere Fallback-Wechsel und zeitliche Aggregation für Lokalisierung – machen Astra zu einem Kandidaten nicht nur für einzelne Gebäude, sondern für stadtweite, standortübergreifende Flotten.

Erkenntnis: Der Rollout gelingt, wenn Semantik, Planung und Vertrauenswerte über ROS2 wie jeder gut gebaute Knoten fließen.

Warum Astra über ein Unternehmen hinaus wichtig ist: Standards, Wettbewerb und der Weg zur universellen Mobilität

Die Veröffentlichung von ByteDance reiht sich in ein Ökosystem ein, das universelle mobile Roboter anstrebt. Das Dual-Modell-Muster formt eine Grenze, die viele Teams bereits kennen: globale Kognition versus lokale Reflexe. Es bietet auch ein gemeinsames Vokabular für Benchmarks und Sicherheitsüberprüfungen – Wahrzeichen, Knotenassoziationen, ESDF-Abstände – die Integratoren prüfen können. Diese Klarheit gewinnt an Bedeutung, da Vorschriften zur Mensch-Roboter-Interaktion im öffentlichen Raum strenger werden.

Positionierung unter führenden Akteuren

Firmen wie Boston Dynamics haben physische Zuverlässigkeit gemeistert; Astra liefert semantische Verankerung und sprach-native Ziele als Ergänzung dieser Hardware. ABB Robotics und Honda Robotics können mobile Manipulatoren mit benannten Arbeitsplätzen ohne QR-Codes verbinden. Verbraucherakteure wie iRobot und Samsung Robotics erhalten robuste „Raumnamen“ ohne aufwendige Leuchtfeuer. Mit NVIDIA Edge-Beschleunigung und optionalen OpenAI-ähnlichen Instruktions-Stacks ist der Klebstoff genau dort, wo viele Teams bereits bauen.

- 🧠 Globale Semantik: beseitigt die Notwendigkeit dichter künstlicher Wahrzeichen.

- 🦾 Hardware-Synergie: ergänzt beinige, radbasierte und hybride Basen.

- 🧪 Reproduzierbare Tests: ESDF-Abstände und Positionsfehler lassen sich standortübergreifend vergleichen.

Was 2025 die Gewinner ausmacht

Gewinner liefern Flotten, die mit minimalem Remapping und ohne brüchige Regeln in neue Gebäude gebracht werden können. Das bedeutet Investitionen in Kartenkompression, die die richtigen Semantiken erhält, in zeitliches Denken, um Feature-arme Zonen zu überleben, und in Policies, die Vertrauen offenlegen, damit Menschen ohne Mikromanagement beaufsichtigen können. Das grob-zu-feine globale Suchen und die vorausschauende lokale Planung von Astra sind praktische Schritte zu diesem Ziel.

| Fähigkeit 🧩 | Astras Ansatz 🧠 | Warum es skaliert 📈 | Betriebliche Wirkung 🧰 |

|---|---|---|---|

| Selbst-/Ziellokalisierung | Multimodal + semantischer Graph | Handhabt Mehrdeutigkeit | Weniger Bedieneranrufe 📞 |

| Lokale Planung | Flussabgleich + maskierter ESDF | OOD-Resilienz | Geringeres Kollisionsrisiko 🚧 |

| Odometrie | Transformer-Fusion | Sensor-agnostisch | Weniger Drift 🧭 |

| Sprachaufgaben | Visuell-sprachliche Verankerung | Menschengerecht | Schnellerer Aufgabenstart ⏱️ |

- 🛰️ Kurzfristig: Piloten ausliefern, die Positionsfehler, ESDF-Abstände und Übergaben messen.

- 🏗️ Mittelfristig: Zeitliche Lokalisierung und aktive Erkundung für feature-arme Zonen ergänzen.

- 🌍 Langfristig: Semantische Tags über Standorte hinweg standardisieren, um Karten und Policies zu teilen.

Erkenntnis: Ein Dual-Modell-Standard gibt Integratoren einen stabilen Vertrag: globale Semantik rein, sichere lokale Bewegung raus.

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Was macht Astra anders als traditionelle Navigations-Stacks?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Es konsolidiert viele brüchige Module in zwei Modelle: Astra-Global für multimodale Selbst-/Ziellokalisierung mittels semantisch-topologischer Karte und Astra-Local für vorausschauende Planung und genaue Odometrie. Die Aufteilung bewahrt hochstufiges Denken und gleichzeitig schnelle, sichere Steuerung auf niedriger Ebene.”}},{“@type”:”Question”,”name”:”Kann Astra auf gängiger Edge-Hardware laufen?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Ja. Teams zielen typischerweise auf NVIDIA Jetson-Klassenmodule für Multi-Kamera-Pipelines und können auf diskrete GPUs für größere Anlagen skalieren. Die Integration über ROS2 hält den Rollout einfach.”}},{“@type”:”Question”,”name”:”Wie verarbeitet Astra Anweisungen in natürlicher Sprache?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Astra-Global verankert Text in semantischen Wahrzeichen und Knoten der Karte über ein grob-zu-fein visuell-sprachliches Verfahren und liefert Zielbilder und 6-DoF-Posen, zu denen Astra-Local navigieren kann.”}},{“@type”:”Question”,”name”:”Ist Astra kompatibel mit existierenden Robotern?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Die Architektur ist robotunabhängig. Plattformen von Boston Dynamics, Fetch Robotics, ABB Robotics, Honda Robotics, iRobot und Samsung Robotics können via ROS2 integriert werden, sofern geeignete Sensoren (Multi-Kamera, IMU, Räder) vorhanden sind.”}},{“@type”:”Question”,”name”:”Was sind die wichtigsten Einschränkungen, die man beachten sollte?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Die Einzelbild-Lokalisierung kann in feature-armen oder stark sich wiederholenden Bereichen Schwierigkeiten haben, und starke Kartenkompression kann Semantik verlieren. Die Roadmap umfasst zeitliches Denken, aktive Erkundung und verbesserte Fallback-Wechsel.”}}]}Was macht Astra anders als traditionelle Navigations-Stacks?

Es konsolidiert viele brüchige Module in zwei Modelle: Astra-Global für multimodale Selbst-/Ziellokalisierung mittels semantisch-topologischer Karte und Astra-Local für vorausschauende Planung und genaue Odometrie. Die Aufteilung bewahrt hochstufiges Denken und gleichzeitig schnelle, sichere Steuerung auf niedriger Ebene.

Kann Astra auf gängiger Edge-Hardware laufen?

Ja. Teams zielen typischerweise auf NVIDIA Jetson-Klassenmodule für Multi-Kamera-Pipelines und können auf diskrete GPUs für größere Anlagen skalieren. Die Integration über ROS2 hält den Rollout einfach.

Wie verarbeitet Astra Anweisungen in natürlicher Sprache?

Astra-Global verankert Text in semantischen Wahrzeichen und Knoten der Karte über ein grob-zu-fein visuell-sprachliches Verfahren und liefert Zielbilder und 6-DoF-Posen, zu denen Astra-Local navigieren kann.

Ist Astra kompatibel mit existierenden Robotern?

Die Architektur ist robotunabhängig. Plattformen von Boston Dynamics, Fetch Robotics, ABB Robotics, Honda Robotics, iRobot und Samsung Robotics können via ROS2 integriert werden, sofern geeignete Sensoren (Multi-Kamera, IMU, Räder) vorhanden sind.

Was sind die wichtigsten Einschränkungen, die man beachten sollte?

Die Einzelbild-Lokalisierung kann in feature-armen oder stark sich wiederholenden Bereichen Schwierigkeiten haben, und starke Kartenkompression kann Semantik verlieren. Die Roadmap umfasst zeitliches Denken, aktive Erkundung und verbesserte Fallback-Wechsel.

-

Open Ai7 days ago

Open Ai7 days agoEntfesselung der Power von ChatGPT-Plugins: Verbessern Sie Ihr Erlebnis im Jahr 2025

-

Open Ai6 days ago

Open Ai6 days agoMastering GPT Fine-Tuning: Ein Leitfaden zur effektiven Anpassung Ihrer Modelle im Jahr 2025

-

Open Ai6 days ago

Open Ai6 days agoVergleich von OpenAIs ChatGPT, Anthropics Claude und Googles Bard: Welches generative KI-Tool wird 2025 die Vorherrschaft erlangen?

-

Open Ai6 days ago

Open Ai6 days agoChatGPT-Preise im Jahr 2025: Alles, was Sie über Tarife und Abonnements wissen müssen

-

Open Ai6 days ago

Open Ai6 days agoDas Auslaufen der GPT-Modelle: Was Nutzer im Jahr 2025 erwartet

-

KI-Modelle6 days ago

KI-Modelle6 days agoGPT-4-Modelle: Wie Künstliche Intelligenz das Jahr 2025 verändert