Herramientas

Desbloqueando la Eficiencia del Proyecto: Cómo Aprovechar Azure ChatGPT para el Éxito en 2025

Configuración de Azure ChatGPT que realmente marca la diferencia en 2025

Los equipos que escalan en 2025 comienzan diseñando Azure OpenAI para ajustarse a las presiones reales de entrega: velocidad, cumplimiento y ROI medible. Las implementaciones más efectivas tratan a Azure como el centro neurálgico, utilizando aislamiento de red, endpoints privados y control de acceso basado en roles para asegurar que las indicaciones y resultados permanezcan dentro de los límites de la empresa. Una decisión inteligente inicial es la selección y fundamentación del modelo. Para el trabajo en proyectos, las organizaciones suelen combinar un modelo grande de alto rendimiento con Azure Cognitive Search para fundamentar las respuestas en sus manuales PMO, SOPs y datos de entrega. Esto reduce las alucinaciones y acelera la incorporación de nuevos colaboradores que pueden consultar decisiones históricas al instante.

La provisión es optimizada, pero la precisión importa. Una construcción de grado producción típicamente incluye un recurso Azure OpenAI, Key Vault para secretos, Storage para transcripciones y artefactos, y una capa API ligera para mediar las solicitudes y aplicar presupuestos. Los líderes que buscan victorias rápidas permiten que los equipos de proyecto comiencen con “bots de espacio de trabajo” que hacen seguimiento de reuniones diarias, sintetizan riesgos y redactan actualizaciones, para luego escalar a asistentes a nivel organizacional tras fortalecer políticas. Para mantener el contenido alineado al mensaje, las instrucciones personalizadas—que reflejan el tono de la compañía—se fijan. Muchos equipos también integran el bot directamente en Microsoft Teams para resumir llamadas y convertir decisiones en elementos de backlog.

Considera la empresa ficticia de ingeniería “Rivermark Systems.” En el primer trimestre, la PMO lanzó un asistente fundamentado entrenado en su modelo de gobernanza y retrospectivas previas. En pocas semanas, el tiempo dedicado a preparar actualizaciones para stakeholders se redujo en un 38%, y el tiempo de incorporación bajó dos sprints. Su líder operativo atribuye el éxito a un enfoque de dos velocidades: experimentos rápidos en sandbox, seguidos de un ciclo de formalización que añadió observabilidad, límites de costo y pruebas de red team. El mismo patrón es replicable en múltiples industrias, si la construcción se alinea con los puntos dolorosos reales del proyecto.

Para contexto adicional sobre tendencias de capacidad y niveles de modelos, los equipos a menudo revisan una reseña 2025 de capacidades de ChatGPT y notas de evolución del modelo como insights sobre la última familia GPT-4. Las decisiones de infraestructura también se ven influenciadas por la residencia de datos y la planificación de capacidad; la cobertura reciente de nuevas inversiones en centros de datos subraya por qué la latencia y disponibilidad pueden variar por región—crítico para equipos globales con proyectos “follow-the-sun”.

Pasos clave que reducen la fricción en la implementación

- 🧭 Definir el alcance del proyecto: metas, KPIs, restricciones y umbrales de riesgo.

- 🔒 Configurar endpoints privados, RBAC y Key Vault para secretos.

- 🧠 Seleccionar un modelo y estrategia de fundamentación usando documentos empresariales y registros de decisiones.

- 🧩 Añadir conectores a Teams, Outlook y tu cadena de herramientas PM para flujo de extremo a extremo.

- 🧪 Pilotar en un portafolio, recolectar evidencia y luego codificar patrones como plantillas reutilizables.

| Tarea de configuración ⚙️ | Servicio Azure 🧱 | Resultado 🎯 | Tiempo ahorrado ⏱️ |

|---|---|---|---|

| Provisionamiento seguro | Azure OpenAI + Key Vault | Secretos rotados, listo para auditoría | 2–3 horas/semana ✅ |

| Fundamentación en docs PMO | Cognitive Search | Bajas alucinaciones, respuestas alineadas | 5–7 horas/semana 📉 |

| Integración con Teams | Graph API + Logic Apps | Resúmenes automáticos y elementos de acción | 3 horas/semana 🗂️ |

| Guardarraíles de presupuesto | API gateway + tags | Visibilidad y límites de gasto | Control de costos directos 💸 |

Una última idea: comienza con la fricción que bloquea tu hoja de ruta—cambios de estado, cuellos de botella en pruebas o seguimiento de riesgos—y deja que el asistente lo resuelva con enfoque implacable. Todo lo demás puede seguir.

Automatización de flujo de trabajo: Combinando Azure ChatGPT con Microsoft 365, GitHub, Visual Studio y Power BI

La verdadera eficiencia llega cuando Azure ChatGPT está conectado a herramientas diarias. Las grabaciones de reuniones se convierten en decisiones estructuradas, las revisiones de código se vuelven consistentes y los paneles evolucionan de estáticos a adaptativos. Los líderes de proyecto comúnmente enlazan Microsoft 365, GitHub, Visual Studio y Power BI para asegurar que lo discutido se refleje instantáneamente en elementos de trabajo, documentación y métricas. El tejido conectivo suele ser Azure Logic Apps o Power Automate, con una capa API ligera para estandarizar indicaciones y controlar costos.

Tras una llamada con un cliente en Teams, las transcripciones fluyen hacia el asistente para extraer objetivos, señales de riesgo y responsables. Luego, el bot propone elementos de backlog con criterios de aceptación y los asigna mediante la herramienta PM elegida. En flujos de trabajo de código, Azure ChatGPT redacta descripciones de pull requests y verifica el cumplimiento de políticas. Para análisis, Power BI puede llamar al asistente para traducir gráficos en narrativas listas para stakeholders en segundos. El resultado es una cadencia más fluida donde los líderes revisan resultados en lugar de reinventar el proceso cada semana.

Los equipos que buscan palancas más allá de las funciones integradas pueden explorar capacidades estilo plugin y consejos prácticos del playground para poner a prueba las indicaciones. Para quienes evalúan opciones de ecosistema, esta visión general de posicionamiento Microsoft vs. OpenAI Copilot es una lente útil para decidir dónde deben residir los asistentes en desarrollo, PMO y operaciones financieras.

Patrones de automatización que entregan consistentemente

- 📝 Reunión a backlog: Resume llamadas en Teams, genera historias de usuario, las envía a repos o tableros PM.

- 🔍 PRs conscientes de políticas: Redacta y valida plantillas de PR en GitHub y Visual Studio.

- 📊 Analítica explicable: Convierte visuales de Power BI en narrativas listas para stakeholders.

- 🔁 Control de cambios: Completa automáticamente registros de cambios y avisos a stakeholders cuando el alcance cambia.

- 📥 Triaje de bandeja de entrada: Categoriza correo y crea tareas con responsables y fechas límite.

| Caso de uso 🚀 | Herramientas 🧰 | Resultado IA 🤖 | Impacto 📈 |

|---|---|---|---|

| Resumen Teams | Teams + Azure OpenAI | Decisiones, riesgos, responsables | Menos acciones perdidas ✅ |

| Flujo dev | GitHub + Visual Studio | PRs consistentes, chequeos de política | Revisiones más rápidas ⚡ |

| Historias analíticas | Power BI | Narrativas autogeneradas | Comunicación más clara 🗣️ |

| Control de cambios | Logic Apps | Plantillas automatizadas | Menos tiempo administrativo ⏳ |

Una vez establecidos estos patrones, los líderes pueden ampliar la cobertura: mapas de calor de riesgo alimentados por señales en tiempo real, o metas de sprint convertidas en actualizaciones OKR automatizadas. La recompensa se multiplica a lo largo de los trimestres.

Ritmo Ágil: Potenciando Jira, Trello, Asana y Slack con Azure ChatGPT

Los equipos ágiles prosperan con claridad, y allí es donde los asistentes brillan. Conectar Azure ChatGPT a Jira, Trello, Asana y Slack crea un ciclo de retroalimentación donde la planificación, ejecución y aprendizaje avanzan más rápido juntos. La preparación del backlog se vuelve proactiva. Las reuniones diarias se sintetizan en temas, y los bloqueos activan playbooks predefinidos. El asistente puede estandarizar criterios de aceptación mientras se mantiene flexible para el estilo Scrum o Kanban de cada escuadrón.

Imagina “Solstice Commerce,” un minorista global con seis escuadrones. El asistente monitorea canales de Slack por frases de riesgo (“bloqueado,” “rollback,” “revisión de seguridad”), las marca dentro de Jira, propone pasos de mitigación basados en postmortems anteriores y notifica al responsable adecuado. En lugar de un aluvión de actualizaciones, los líderes de producto reciben un único informe diario que mezcla el estado de entrega con impactos a stakeholders. Esto no reemplaza rituales; los hace incisivos y repetibles.

Los líderes que comparan ecosistemas también analizan compensaciones de capacidad, a menudo consultando una visión equilibrada como ChatGPT vs. Claude en 2025 o comparaciones más amplias de asistentes. Para señales más generales de transformación IA, análisis sobre adopción empresarial y el panorama de las principales empresas IA ayudan a PMOs a prever dónde apostar a continuación.

Casos de uso tangibles para equipos de producto y entrega

- 🧱 Preparación de backlog: Normaliza el tamaño de historias, agrega criterios de aceptación faltantes y enlaza dependencias.

- ⏰ Síntesis de standup: Convierte threads de Slack en tres temas y acciones sucintas.

- 🧩 Notas de lanzamiento: Genera notas para usuarios y runbooks internos desde PRs fusionados.

- 🧪 Andamiaje de pruebas: Propone listas de verificación de pruebas humo y de regresión según riesgo de características.

- 🔁 Memoria retro: Aplica lecciones aprendidas a épicas similares próximas.

| Tarea ágil 🧭 | Cadena de herramientas 🔗 | Rol del asistente 🤝 | Resultado 🌟 |

|---|---|---|---|

| Formación de historias | Jira / Trello / Asana | Revisa alcance, agrega criterios | Historias consistentes ✅ |

| Triaje de bloqueos | Slack + Jira | Marca riesgos, sugiere soluciones | Desbloqueos más rápidos 🧯 |

| Empaque de lanzamiento | GitHub + tableros PM | Redacta notas y runbooks | Transferencias más limpias 📦 |

| Regresiones | Suites de prueba | Genera plantillas de listas de verificación | Cobertura mayor 🧪 |

Cuando los escuadrones sienten el ritmo, los ciclos de planificación se acortan sin comprometer la calidad. Esa es la señal de una agilidad genuina.

Gobernanza de nivel empresarial: Seguridad, costos y límites de tasa sin dramas

Los proyectos empresariales triunfan por confianza. Eso significa que seguridad, control de costos y confiabilidad se tratan como características, no como después de pensar. Empieza separando entornos (dev/test/prod), aplicando indicaciones seguras con PII y activando filtros de contenido. Guarda registros y checkpoints con revisión humana para cambios que impacten cumplimiento, clientes o dinero. Para costos, estandariza patrones de indicaciones y presupuestos de tokens, implementando una lógica de “camino de menor costo” que canalice tareas pequeñas a modelos ligeros mientras reserva el razonamiento pesado para análisis complejos.

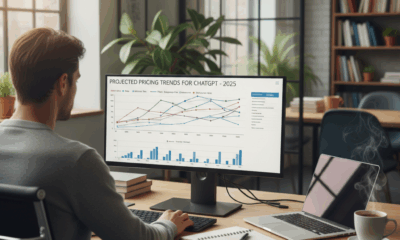

Los equipos validan regularmente sus suposiciones contra benchmarks públicos y guías prácticas. Por ejemplo, entender límites de tasa y concurrencia evita sorpresas por limitaciones en lanzamientos críticos. Con palancas de precios cambiando, el liderazgo suele revisar estrategias de precios en 2025 y análisis sinceros de posicionamiento OpenAI vs. Anthropic para diversificar opciones. Para postura de riesgo y modos de falla, una visión práctica de limitaciones y estrategias de mitigación ayuda a diseñar planes de contingencia elegantes en lugar de cadenas frágiles.

Mira más allá del software. La aceleración por hardware y las iniciativas gubernamentales-industriales moldean capacidad y políticas. Los informes ejecutivos de eventos como los foros de NVIDIA en DC y colaboraciones a nivel municipal como las alianzas de ciudades inteligentes insinúan cambios inminentes en infraestructura y gobernanza que los CIOs deben integrar en sus hojas de ruta.

Controles que mantienen los proyectos seguros, rápidos y asequibles

- 🛡️ Aplicación de políticas: Plantillas de indicaciones, redacción de PII y filtros de contenido por defecto.

- 💰 Presupuestos y etiquetas: Contadores de costo por proyecto con alertas y auto-reducción.

- 🧪 Gateways de validación: Revisión humana para salidas de alto impacto y textos para clientes.

- 📊 Observabilidad: Métricas de latencia, tokens, costo y puntuaciones de satisfacción.

- 🔄 Fallos alternos: Cache de respuestas frecuentes, cambio de modelos durante picos, degradación elegante.

| Riesgo 🧨 | Control 🧰 | Función Azure 🔒 | Señal de éxito ✅ |

|---|---|---|---|

| Fuga de datos | Aislamiento de red, RBAC | Endpoints privados | Sin acceso entre inquilinos 🔍 |

| Exceso de costos | Presupuestos de tokens, alertas | Etiquetas + paneles | Costo/unidad estable 📉 |

| Picos de latencia | Cola + cacheo | API gateway | SLA cumplido en picos ⏱️ |

| Brechas de gobernanza | Gateways de revisión | Registros de auditoría | Pasa auditorías internas 🧾 |

Cuando la gobernanza es invisible y confiable, los equipos confían en el sistema, y la confianza acelera todo lo demás.

Pronósticos, decisiones y KPIs: Transformando ChatGPT en un motor de rendimiento de proyectos

Un pronóstico preciso es la diferencia entre recuperaciones heroicas y entregas calmadas. Azure ChatGPT puede servir como una interfaz conversacional para métodos probados: simulaciones de cronograma Monte Carlo, análisis de tendencias burn-up y detección de variaciones presupuestarias. Dale historiales de sprint, tiempos de entrega y cambios de alcance. El asistente traduce señales en probabilidades, escenarios y compensaciones que los ejecutivos pueden debatir en una reunión, no en tres. Varios PMOs ahora integran asistentes en Power BI para que un stakeholder pueda preguntar, “¿Cuál es la confianza de llegar en junio?” y recibir un desglose ligado a factores concretos como riesgo de dependencias, personal y volatilidad.

Investigadores y practicantes destacan el rol de la IA en la planificación predictiva y la ejecución. Para un panorama más amplio de hacia dónde va la adopción empresarial, los equipos estudian estrategias de optimización de indicaciones junto a resúmenes de ecosistemas como tendencias de transformación IA y FAQs pragmáticas que abordan realidades del proyecto. Combínalo con la perspectiva del lado de entrega: mejora la calidad del backlog, disminuye retrabajo y la capacidad de riesgo se vuelve explícita y no solo una sensación.

Para mantener la honestidad de los pronósticos, define KPIs que reflejen throughput y satisfacción. Un asistente puede calcular estabilidad de historias (ítems reabiertos por sprint), latencia de decisiones (tiempo desde que se plantea un problema hasta que se asigna un responsable) y profundidad de revisiones (comentarios significativos por PR). Cuando los números cambian, puede explicar el motivo—en lenguaje simple—para que los escuadrones actúen sin esperar un postmortem trimestral.

Diseño de KPIs que impulsa el comportamiento—no el trabajo ocupado

- 📦 Throughput con calidad: Historias completadas con tasa cero de reapertura.

- 🧭 Previsibilidad: Variación entre pronóstico y tiempo de ciclo real.

- 🗣️ Claridad para stakeholders: Puntuaciones de legibilidad de actualizaciones y tiempo de respuesta.

- 🧪 Aseguramiento de pruebas: Crecimiento de cobertura y tasa de defectos escapados.

- 🤝 Colaboración: Tiempo para mergear y profundidad de revisión en GitHub.

| Métrica 📊 | Base 🧩 | Objetivo 🎯 | Rol del asistente 🤖 |

|---|---|---|---|

| Precisión de pronóstico | ±35% | ±10% | Explicadores de escenarios ✅ |

| Tasa de reapertura | 12% | 4% | Plantillas AC y verificaciones 🧠 |

| Latencia de decisiones | 3.5 días | 1 día | Recordatorios al responsable en Slack ⏰ |

| Costo por historia | $450 | $320 | Presupuestos de tokens + enrutamiento 💸 |

Cuando los KPIs premian claridad y consistencia, el asistente se convierte en un amplificador de rendimiento—no otro panel que nadie revisa.

De piloto a portafolio: patrones y cultura para escalar en 2025

Escalar Azure ChatGPT en portafolios es un proyecto cultural tanto como tecnológico. Los pilotos demuestran valor en un dominio; escalar requiere gobernanza, habilitación y comunidad. Comienza modelando tus éxitos: bibliotecas de indicaciones, conectores y políticas de costo que hicieron funcionar el piloto. Empaquétalos como “planos de IA” internos para que otros equipos puedan lanzar en días, no meses. Construye un ciclo de habilitación—horas de oficina, podcasts internos y cápsulas de entrenamiento cortas—para que el impulso nunca decaiga.

Elige temas transversales donde la IA cree valor compuesto: soporte al cliente, cumplimiento de políticas y documentación. Incluso los equipos pequeños ven ganancias desproporcionadas al introducir asistentes potenciados por OpenAI para triaje y recuperación de conocimiento. Si tu liderazgo compara ecosistemas externos para opciones, sintetiza perspectivas con una visión clara como OpenAI vs. Anthropic en 2025 y cobertura adyacente sobre inversión en innovación regional. La señal: capacidad sostenida, políticas claras y pipelines de talento impulsan operaciones IA escalables.

Las disciplinas de proyectos también deben evolucionar. Los registros de riesgo cambian de registros estáticos a sistemas vivos. Las lecciones aprendidas se convierten en “átomos de conocimiento” que los asistentes reusan en trabajos similares. Los casos de negocio incluyen costos de tokens y límites de concurrencia de la misma forma que incluyen computación en la nube. Comunica estos cambios sin jerga y acompáñalos con victorias visibles—una reducción del 20% en retrabajo o un corte del 30% en tiempo de preparación de estado—para que la adopción se sienta como alivio y no como fatiga por cambios.

Manual para escalar de forma sostenible

- 📚 Planos: Empaqueta indicaciones, flujos, políticas y ejemplos para reutilización.

- 🧑🏫 Habilitación: Microaprendizaje para PMs, desarrolladores y analistas—específico por rol y práctico.

- 🧪 Cuota de experimentos: Reserva capacidad para experimentos mensuales que puedan llegar a estándares.

- 🔄 Ciclos de retroalimentación: Monitorea satisfacción y adopción; incorpora aprendizajes a los planos.

- 🏁 Historias de resultados: Comparte métricas antes/después para mantener la narrativa creíble.

| Palanca de escala 🧱 | Qué incluye 🧩 | Quién la posee 👤 | Señal de triunfo 🏆 |

|---|---|---|---|

| Planos de IA | Indicaciones, flujos, políticas | PMO + Plataforma | Despegue en la semana 1 🚀 |

| Guardarraíles de costo | Presupuestos, alertas, enrutamiento | FinOps | Costo unitario estable 💵 |

| Controles de riesgo | Red teams, auditorías | Seguridad | Sin incidentes críticos 🛡️ |

| Pipeline de talento | Entrenamiento, gremios | People Ops | Adopción creciente 📈 |

El escalado sucede cuando la gente se siente habilitada y protegida, y cuando las victorias son demasiado evidentes para ignorarlas.

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”How can teams reduce hallucinations when using Azure ChatGPT for project work?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Ground the assistant with Azure Cognitive Search over your PMO docs, SOPs, and decision logs; use strict prompt templates; and require citations. Add validation gates for customer-facing outputs and cache approved answers for reuse.”}},{“@type”:”Question”,”name”:”Whatu2019s the fastest first workflow to automate?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Meeting-to-backlog. Summarize Teams calls, extract decisions, draft stories with acceptance criteria, and push them into Jira, Trello, or Asana. It demonstrates value within days and reduces status churn immediately.”}},{“@type”:”Question”,”name”:”How do we manage costs as usage scales?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Implement token budgets per project, route simple tasks to lighter models, monitor cost-per-outcome in Power BI, and alert on spikes. Reference current guidance on pricing dynamics and rate limits to avoid surprises.”}},{“@type”:”Question”,”name”:”Where do dev tools fit into the picture?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Integrate GitHub and Visual Studio so the assistant drafts PR descriptions, checks policy adherence, and links documentation. The goal is consistent, reviewable automation that speeds delivery without hiding details.”}},{“@type”:”Question”,”name”:”What signals show itu2019s time to scale beyond a pilot?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Stable unit costs, improved forecast accuracy, lower reopen rates, and positive stakeholder satisfaction. When three or more persist across two quarters, package the patterns as blueprints and scale.”}}]}¿Cómo pueden los equipos reducir las alucinaciones al usar Azure ChatGPT para trabajo de proyectos?

Fundamente el asistente con Azure Cognitive Search en sus documentos PMO, SOPs y registros de decisiones; use plantillas estrictas para indicaciones; y requiera citas. Agregue puertas de validación para salidas orientadas al cliente y almacene en caché respuestas aprobadas para reutilización.

¿Cuál es el flujo de trabajo inicial más rápido para automatizar?

Reunión a backlog. Resuma llamadas de Teams, extraiga decisiones, redacte historias con criterios de aceptación y envíelas a Jira, Trello o Asana. Demuestra valor en días y reduce la rotación de estado de inmediato.

¿Cómo gestionamos costos a medida que el uso escala?

Implemente presupuestos de tokens por proyecto, dirija tareas simples a modelos más ligeros, monitoree costo por resultado en Power BI y alerte sobre picos. Consulte la guía actual sobre dinámica de precios y límites de tasa para evitar sorpresas.

¿Dónde encajan las herramientas de desarrollo en el panorama?

Integre GitHub y Visual Studio para que el asistente redacte descripciones de PR, verifique cumplimiento de políticas y enlace documentación. El objetivo es una automatización consistente y revisable que acelere la entrega sin ocultar detalles.

¿Qué señales muestran que es tiempo de escalar más allá de un piloto?

Costos unitarios estables, mejora en precisión de pronósticos, tasas más bajas de reapertura y satisfacción positiva de stakeholders. Cuando tres o más persisten durante dos trimestres, empaquete los patrones como planos y escale.

-

Open Ai1 week ago

Open Ai1 week agoDesbloqueando el Poder de los Plugins de ChatGPT: Mejora Tu Experiencia en 2025

-

Open Ai7 days ago

Open Ai7 days agoDominando la Fine-Tuning de GPT: Una guía para personalizar eficazmente tus modelos en 2025

-

Open Ai7 days ago

Open Ai7 days agoComparando ChatGPT de OpenAI, Claude de Anthropic y Bard de Google: ¿Qué herramienta de IA generativa reinará suprema en 2025?

-

Open Ai6 days ago

Open Ai6 days agoPrecios de ChatGPT en 2025: Todo lo que necesitas saber sobre tarifas y suscripciones

-

Open Ai7 days ago

Open Ai7 days agoLa eliminación progresiva de los modelos GPT: qué pueden esperar los usuarios en 2025

-

Modelos de IA7 days ago

Modelos de IA7 days agoModelos GPT-4: Cómo la inteligencia artificial está transformando 2025