Outils

Libérer l’efficacité des projets : comment tirer parti d’Azure ChatGPT pour réussir en 2025

Configuration Azure ChatGPT Qui Fait Vraiment Bouger les Choses en 2025

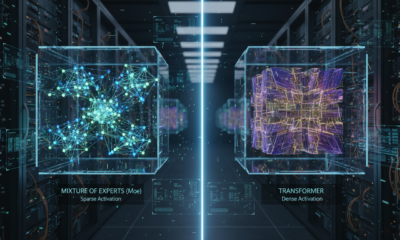

Les équipes qui se développent en 2025 commencent par concevoir Azure OpenAI pour correspondre aux véritables contraintes de livraison : rapidité, conformité et ROI mesurable. Les déploiements les plus efficaces considèrent Azure comme le centre névralgique, utilisant l’isolation réseau, les points de terminaison privés et l’accès basé sur les rôles pour garantir que les prompts et les résultats restent à l’intérieur des limites de l’entreprise. Une première décision intelligente est la sélection et l’ancrage du modèle. Pour le travail de projet, les organisations combinent souvent un modèle large performant avec Azure Cognitive Search afin d’ancrer les réponses sur leurs playbooks PMO, SOP et les données de livraison. Cela réduit les hallucinations et accélère l’intégration des nouveaux contributeurs qui peuvent interroger instantanément les décisions historiques.

La provision est simplifiée, mais la précision compte. Une construction de qualité production comprend généralement une ressource Azure OpenAI, un Key Vault pour les secrets, un Stockage pour les transcriptions et artefacts, ainsi qu’une couche API légère pour gérer les requêtes et appliquer les budgets. Les leaders souhaitant des gains rapides laissent les équipes projet commencer avec des “bots d’espace de travail” qui suivent les standups, synthétisent les risques et rédigent les mises à jour, puis passent à des assistants à l’échelle de l’organisation après renforcement des politiques. Pour garder le contenu conforme au message, les instructions personnalisées — reflétant le ton d’une entreprise — sont verrouillées. De nombreuses équipes intègrent également le bot directement dans Microsoft Teams pour résumer les appels et convertir les décisions en éléments de backlog.

Considérez la société d’ingénierie fictive « Rivermark Systems ». Au T1, le PMO a déployé un assistant ancré formé sur leur modèle de gouvernance et leurs rétrospectives antérieures. En quelques semaines, le temps passé à préparer les mises à jour pour les parties prenantes a diminué de 38 % et le temps d’intégration de deux sprints. Leur responsable opérations attribue ce succès à une approche à deux vitesses : des expérimentations rapides en sandbox, suivies d’un cycle de formalisation ajoutant observabilité, plafonds de coûts et tests de red team. Ce même schéma est reproductible dans tous les secteurs — si la construction correspond aux points de douleur réels du projet.

Pour un contexte supplémentaire sur les tendances des capacités et les niveaux de modèles, les équipes consultent souvent une revue 2025 des capacités de ChatGPT et des notes d’évolution des modèles telles que les insights sur la dernière famille GPT-4. Les décisions d’infrastructure sont également influencées par la résidence des données et la planification des capacités ; une couverture récente de nouveaux investissements en centres de données souligne pourquoi la latence et la disponibilité peuvent varier selon les régions — critique pour les équipes mondiales avec des projets “follow-the-sun”.

Étapes clés qui réduisent la friction de déploiement

- 🧭 Définir la portée du projet : objectifs, KPI, contraintes et seuils de risque.

- 🔒 Configurer les points de terminaison privés, RBAC et Key Vault pour les secrets.

- 🧠 Sélectionner une stratégie de modèle et d’ancrage en utilisant les documents d’entreprise et les journaux de décisions.

- 🧩 Ajouter des connecteurs à Teams, Outlook et votre chaîne d’outils PM pour un flux de bout en bout.

- 🧪 Piloter dans un portefeuille, collecter des preuves, puis codifier les modèles en templates réutilisables.

| Tâche de Configuration ⚙️ | Service Azure 🧱 | Résultat 🎯 | Temps Économisé ⏱️ |

|---|---|---|---|

| Provisionnement sécurisé | Azure OpenAI + Key Vault | Secrets renouvelés, prêt pour audit | 2–3 heures/semaine ✅ |

| Ancrage sur docs PMO | Cognitive Search | Peu d’hallucinations, réponses conformes | 5–7 heures/semaine 📉 |

| Intégration Teams | Graph API + Logic Apps | Résumés automatiques et éléments d’action | 3 heures/semaine 🗂️ |

| Limites budgétaires | API gateway + tags | Visibilité des dépenses et plafonds | Contrôle des coûts directs 💸 |

Une dernière remarque : commencez par le frein unique qui bloque votre feuille de route — changements de statut, goulots d’étranglement de tests ou suivi des risques — et laissez l’assistant résoudre cela avec un focus impitoyable. Tout le reste peut suivre.

Automatisation des Flux de Travail : Associer Azure ChatGPT à Microsoft 365, GitHub, Visual Studio et Power BI

La véritable efficacité arrive quand Azure ChatGPT est connecté aux outils quotidiens. Les enregistrements de réunions deviennent des décisions structurées, les revues de code gagnent en cohérence, et les tableaux de bord passent du statique à l’adaptatif. Les chefs de projet assemblent couramment Microsoft 365, GitHub, Visual Studio et Power BI pour que ce qui est discuté se reflète instantanément dans les éléments de travail, la documentation et les métriques. Le tissu conjonctif est généralement Azure Logic Apps ou Power Automate, avec une fine couche API pour standardiser les prompts et contrôler les coûts.

Après un appel client dans Teams, les transcriptions sont envoyées à l’assistant pour extraire objectifs, signaux de risque et responsables. Le bot propose alors des éléments de backlog avec critères d’acceptation et les assigne via l’outil PM choisi. Dans les flux de développement, Azure ChatGPT rédige les descriptions des pull requests et vérifie la conformité aux politiques. Pour l’analytique, Power BI peut appeler l’assistant pour traduire graphiques en récits prêts pour les parties prenantes en quelques secondes. Le résultat : un rythme plus fluide où les dirigeants passent en revue les résultats au lieu de réinventer le processus chaque semaine.

Les équipes cherchant un levier au-delà des fonctionnalités intégrées peuvent explorer des capacités de type plugin et conseils pratiques pour playground pour tester les prompts. Pour ceux qui évaluent les choix d’écosystèmes, cette vue d’ensemble de la position de Microsoft vs. OpenAI Copilot est une bonne perspective pour décider où loger les assistants entre développement, PMO et opérations financières.

Modèles d’automatisation qui livrent constamment

- 📝 De la réunion au backlog : Résumer les appels Teams, générer des user stories, pousser vers les dépôts ou tableaux PM.

- 🔍 PRs conscientes de la politique : Rédiger et valider des templates de PR dans GitHub et Visual Studio.

- 📊 Analytique explicable : Convertir des visuels Power BI en récits prêts pour parties prenantes.

- 🔁 Contrôle des changements : Remplir automatiquement journaux de changement et notifications parties prenantes lors des décalages de périmètre.

- 📥 Tri de la boîte de réception : Catégoriser les mails et créer des tâches avec responsables et échéances.

| Cas d’Usage 🚀 | Outils 🧰 | Résultat IA 🤖 | Impact 📈 |

|---|---|---|---|

| Récap Teams | Teams + Azure OpenAI | Décisions, risques, responsables | Moins d’actions manquées ✅ |

| Flux de dev | GitHub + Visual Studio | PRs cohérentes, vérifications politiques | Revue plus rapides ⚡ |

| Histoires analytiques | Power BI | Récits auto-générés | Communication plus claire 🗣️ |

| Contrôle des changements | Logic Apps | Templates automatisés | Temps administratif réduit ⏳ |

Une fois ces modèles en place, les leaders peuvent étendre la couverture : cartes thermiques de risque alimentées par des signaux en temps réel, ou objectifs de sprint transformés en mises à jour OKR automatisées. Le retour sur investissement s’accumule au fil des trimestres.

Rythme Agile : Booster Jira, Trello, Asana et Slack avec Azure ChatGPT

Les équipes agiles prospèrent grâce à la clarté, et c’est là que les assistants brillent. Connecter Azure ChatGPT à Jira, Trello, Asana et Slack crée une boucle de rétroaction où planification, exécution et apprentissage avancent plus vite ensemble. Le grooming du backlog devient proactif. Les standups sont synthétisés en thèmes, et les blocages déclenchent des playbooks préconstruits. L’assistant peut standardiser les critères d’acceptation tout en restant flexible selon la saveur Scrum ou Kanban de chaque équipe.

Imaginez « Solstice Commerce », un détaillant mondial avec six équipes. L’assistant surveille les canaux Slack pour des phrases à risque (“bloqué”, “retour en arrière”, “revue sécurité”), les signale dans Jira, propose des mesures d’atténuation issues des postmortems passés, et sollicite le bon responsable. Plutôt qu’une avalanche de mises à jour, les leads produit reçoivent un brief quotidien unique mêlant état de livraison et impacts parties prenantes. Il ne s’agit pas de remplacer les rituels ; c’est les rendre incisifs et répétables.

Les leaders comparant les écosystèmes examinent aussi les compromis de capacités, souvent en se référant à une vue équilibrée telle que ChatGPT vs. Claude en 2025 ou des comparaisons d’assistants plus larges. Pour des signaux plus généraux de transformation IA, les analyses sur l’adoption en entreprise et le paysage des principales entreprises IA aident les PMO à prévoir leurs prochains paris.

Cas d’usage concrets pour équipes produit et livraison

- 🧱 Grooming du backlog : Normaliser la taille des stories, ajouter les critères d’acceptation manquants, et lier les dépendances.

- ⏰ Synthèse des standups : Transformer threads Slack en trois thèmes succincts et actions.

- 🧩 Notes de version : Générer les notes utilisateurs et runbooks internes à partir des PR fusionnées.

- 🧪 Échafaudage de tests : Proposer des checklists de tests smoke et régression selon risque fonctionnel.

- 🔁 Mémoire rétro : Appliquer les leçons apprises à des épiques similaires à venir.

| Tâche Agile 🧭 | Chaîne d’outils 🔗 | Rôle de l’assistant 🤝 | Résultat 🌟 |

|---|---|---|---|

| Mise en forme des stories | Jira / Trello / Asana | Vérifie la portée, ajoute les critères | Stories cohérentes ✅ |

| Tri des blocages | Slack + Jira | Signale les risques, suggère des corrections | Déblocages plus rapides 🧯 |

| Packaging des releases | GitHub + tableaux PM | Rédige notes et runbooks | Transferts plus propres 📦 |

| Régressions | Suites de tests | Génère des templates de checklist | Couverture accrue 🧪 |

Quand les équipes ressentent le rythme, les cycles de planification se raccourcissent sans compromettre la qualité. C’est le signe d’une véritable agilité.

Gouvernance de Niveau Entreprise : Sécurité, Coûts et Limites de Taux Sans Drame

Les projets d’entreprise réussissent grâce à la confiance. Cela signifie que la sécurité, le contrôle des coûts et la fiabilité sont considérés comme des fonctionnalités — pas après coup. Commencez par séparer les environnements (dev/test/prod), appliquer des prompts sans PII, et activer les filtres de contenu. Gardez des logs et des points de contrôle humains pour les changements qui impactent la conformité, les clients ou l’argent. Pour les coûts, standardisez les templates de prompt et les budgets de tokens, et mettez en œuvre une logique de “chemin le moins coûteux” qui oriente les petites tâches vers des modèles légers tout en réservant les raisonnements lourds pour l’analyse complexe.

Les équipes valident régulièrement leurs hypothèses face aux benchmarks publics et guides pratiques. Par exemple, comprendre les limites de taux et la concurrence évite des freinages surprises durant les sorties critiques. Avec les leviers tarifaires qui évoluent, les dirigeants consultent souvent les stratégies tarifaires en 2025 et des analyses franches sur le positionnement OpenAI vs. Anthropic pour diversifier les options. Pour la posture de risque et les modes de défaillance, un regard pratique sur les limitations et stratégies d’atténuation aide les équipes à concevoir des solutions de secours élégantes plutôt que des chaînes fragiles.

Regardez au-delà du logiciel. L’accélération matérielle et les initiatives gouvernement-industrie façonnent la capacité et la politique. Les briefings exécutifs d’événements comme les forums NVIDIA à DC et les collaborations au niveau des villes telles que les partenariats smart city présagent des changements imminents d’infrastructure et de gouvernance que les DSI devraient intégrer dans leurs feuilles de route.

Contrôles qui maintiennent les projets sûrs, rapides et abordables

- 🛡️ Application des politiques : Templates de prompt, rougection PII, et filtres de contenu par défaut.

- 💰 Budgets et tags : Compteurs de coûts par projet avec alertes et auto-régulation.

- 🧪 Portes de validation : Revue humaine pour les sorties à enjeu élevé et textes destinés aux clients.

- 📊 Observabilité : Métriques de latence, tokens, coûts et scores de satisfaction.

- 🔄 Solutions de secours : Mettez en cache les réponses fréquentes, changez de modèle en cas de pointe, dégradez élégamment.

| Risque 🧨 | Contrôle 🧰 | Fonctionnalité Azure 🔒 | Signal de Succès ✅ |

|---|---|---|---|

| Fuite de données | Isolation réseau, RBAC | Points de terminaison privés | Pas d’accès inter-locataires 🔍 |

| Dépassement de coûts | Budgets tokens, alertes | Tags + tableaux de bord | Coût unitaire stable 📉 |

| Pics de latence | Queue + cache | API gateway | SLA respectée pendant les pics ⏱️ |

| Lacunes de gouvernance | Portes de revue | Journaux d’audit | Réussite des audits internes 🧾 |

Quand la gouvernance est invisible et fiable, les équipes font confiance au système — et cette confiance accélère tout le reste.

Prévisions, Décisions et KPIs : Transformer ChatGPT en Moteur de Performance Projet

Des prévisions précises font la différence entre des récupérations héroïques et une livraison calme. Azure ChatGPT peut servir de frontal conversationnel pour des méthodes éprouvées : simulations de planning Monte Carlo, analyses de tendances burn-up et détection des écarts budgétaires. Donnez-lui les historiques de sprint, les délais de réalisation et les changements de périmètre. L’assistant traduit les signaux en probabilités, scénarios et compromis que les dirigeants peuvent débattre en une seule réunion, pas trois. Plusieurs PMO intègrent désormais des assistants dans Power BI pour qu’une partie prenante puisse demander « Quelle est la confiance d’atteindre juin ? » et recevoir une ventilation liée à des facteurs concrets tels que le risque de dépendance, le staffing et la volatilité.

Chercheurs et praticiens soulignent le rôle de l’IA dans la planification prédictive et l’exécution. Pour une vue plus large de l’adoption en entreprise, les équipes étudient les stratégies d’optimisation des prompts ainsi que les panoramas écosystémiques comme les tendances de transformation IA et des FAQs pragmatiques qui abordent les réalités projets. Ajoutez la vue côté livraison : la qualité du backlog s’améliore, les retouches diminuent et la capacité de gestion des risques devient explicite plutôt qu’instinctive.

Pour garder les prévisions honnêtes, définissez des KPIs qui reflètent le débit et la satisfaction. Un assistant peut calculer la stabilité des stories (éléments réouverts par sprint), la latence décisionnelle (temps entre la détection du problème et l’assignation d’un responsable), et la profondeur de revue (commentaires significatifs par PR). Quand les chiffres évoluent, il peut expliquer pourquoi — en langage clair — afin que les équipes agissent sans attendre un postmortem trimestriel.

Conception de KPI qui engendre du comportement — pas du travail inutile

- 📦 Débit avec qualité : Stories complétées sans taux de réouverture.

- 🧭 Prédictibilité : Variance entre prévision et durée effective.

- 🗣️ Clarté pour les parties prenantes : Scores de lisibilité des mises à jour et temps de réponse.

- 🧪 Assurance tests : Croissance de la couverture et taux d’évasion des défauts.

- 🤝 Collaboration : Temps jusqu’à merge et profondeur de revue dans GitHub.

| Métrique 📊 | Référence 🧩 | Objectif 🎯 | Rôle de l’assistant 🤖 |

|---|---|---|---|

| Précision des prévisions | ±35% | ±10% | Explications scénarios ✅ |

| Taux de réouverture | 12% | 4% | Templates AC et contrôles 🧠 |

| Latence décisionnelle | 3,5 jours | 1 jour | Relances propriétaires sur Slack ⏰ |

| Coût par story | 450 $ | 320 $ | Budgets tokens + routage 💸 |

Quand les KPIs récompensent la clarté et la cohérence, l’assistant devient un amplificateur de performance — pas un autre tableau de bord que personne ne consulte.

Du Pilote au Portefeuille : Modèles et Culture d’Échelle pour 2025

Déployer Azure ChatGPT à l’échelle des portefeuilles est un projet culturel autant que technique. Les pilotes prouvent la valeur dans un domaine ; la montée en charge nécessite gouvernance, facilitation et communauté. Commencez par modéliser vos succès : les bibliothèques de prompts, connecteurs et politiques de coûts qui ont rendu le pilote efficace. Emballez-les sous forme de “blueprints IA” internes afin que d’autres équipes puissent lancer en quelques jours, pas en mois. Créez une boucle de facilitation — heures d’ouverture, podcasts internes, et formations courtes — pour maintenir la dynamique.

Choisissez des thèmes transversaux où l’IA crée de la valeur cumulée : support client, conformité politique et documentation. Même les petites équipes voient des gains disproportionnés en introduisant des assistants propulsés par OpenAI pour le triage et la recherche de connaissances. Si votre direction compare des écosystèmes externes pour l’optionnalité, synthétisez les perspectives avec une vue claire comme OpenAI vs. Anthropic en 2025 et une couverture adjacente sur l’investissement régional en innovation. Le signal : capacité soutenue, politiques claires et pipelines de talents alimentent des opérations IA extensibles.

Les disciplines projets doivent aussi évoluer. Les journaux de risques passent de registres statiques à des systèmes vivants. Les leçons apprises deviennent des “atomes de connaissance” que les assistants réappliquent à des travaux similaires. Les business cases intègrent les coûts tokens et les limites concurrentielles comme ils incluent le calcul cloud. Communiquez ces évolutions sans jargon et accompagnez-les de résultats visibles — une baisse de 20 % du rework ou une coupure de 30 % dans la préparation des statuts — pour que l’adoption se ressente comme un soulagement, pas une fatigue du changement.

Feuille de route pour une montée en charge durable

- 📚 Blueprints : Emballer prompts, flux, politiques et exemples pour réutilisation.

- 🧑🏫 Facilitation : Microformations pour PMs, développeurs et analystes — ciblées par rôle et pratiques.

- 🧪 Quota d’expérimentations : Réserver de la capacité pour des tests mensuels pouvant devenir standards.

- 🔄 Boucles de retour : Suivre satisfaction et adoption ; intégrer les insights dans les blueprints.

- 🏁 Histoires de résultats : Partager métriques avant/après pour crédibiliser le récit.

| Levier d’Échelle 🧱 | Ce qu’il inclut 🧩 | Responsable 👤 | Signal de Succès 🏆 |

|---|---|---|---|

| Blueprints IA | Prompts, flux, politiques | PMO + Plateforme | Démarrage en semaine 1 🚀 |

| Garde-fous de coûts | Budgets, alertes, routage | FinOps | Coût unitaire stable 💵 |

| Contrôles de risques | Red teams, audits | Sécurité | Aucun incident critique 🛡️ |

| Pipeline de talents | Formation, guildes | People Ops | Adoption élargie 📈 |

L’échelle se produit quand les gens se sentent habilités et protégés, et quand les gains sont trop évidents pour être ignorés.

{« @context »: »https://schema.org », »@type »: »FAQPage », »mainEntity »:[{« @type »: »Question », »name »: »Comment les équipes peuvent-elles réduire les hallucinations lorsqu’elles utilisent Azure ChatGPT pour le travail de projet ? », »acceptedAnswer »:{« @type »: »Answer », »text »: »Ancrez l’assistant avec Azure Cognitive Search sur vos documents PMO, SOP et journaux de décisions ; utilisez des templates de prompt stricts ; et exigez des citations. Ajoutez des portes de validation pour les sorties destinées aux clients et mettez en cache les réponses approuvées pour réutilisation. »}},{« @type »: »Question », »name »: »Quel est le premier flux de travail à automatiser le plus rapidement ? », »acceptedAnswer »:{« @type »: »Answer », »text »: »De la réunion au backlog. Résumez les appels Teams, extrayez les décisions, rédigez les stories avec critères d’acceptation, et poussez-les dans Jira, Trello ou Asana. Cela démontre sa valeur en quelques jours et réduit immédiatement les changements de statut. »}},{« @type »: »Question », »name »: »Comment gérons-nous les coûts à mesure que l’usage augmente ? », »acceptedAnswer »:{« @type »: »Answer », »text »: »Mettez en œuvre des budgets de tokens par projet, orientez les tâches simples vers des modèles légers, contrôlez le coût par résultat dans Power BI, et déclenchez des alertes en cas de pics. Référez-vous aux guides actuels sur la tarification et les limites de taux pour éviter les surprises. »}},{« @type »: »Question », »name »: »Quelle place occupent les outils de développement dans le schéma ? », »acceptedAnswer »:{« @type »: »Answer », »text »: »Intégrez GitHub et Visual Studio pour que l’assistant rédige les descriptions de PR, vérifie la conformité aux politiques, et lie la documentation. L’objectif est une automatisation cohérente, révisable, qui accélère la livraison sans masquer les détails. »}},{« @type »: »Question », »name »: »Quels signaux montrent qu’il est temps de passer à l’échelle au-delà du pilote ? », »acceptedAnswer »:{« @type »: »Answer », »text »: »Coûts unitaires stables, amélioration de la précision des prévisions, baisse des taux de réouverture et satisfaction positive des parties prenantes. Quand trois de ces indicateurs persistent sur deux trimestres, emballez les modèles sous forme de blueprints et déployez à l’échelle. »}}]}Comment les équipes peuvent-elles réduire les hallucinations lorsqu’elles utilisent Azure ChatGPT pour le travail de projet ?

Ancrez l’assistant avec Azure Cognitive Search sur vos documents PMO, SOP et journaux de décisions ; utilisez des templates de prompt stricts ; et exigez des citations. Ajoutez des portes de validation pour les sorties destinées aux clients et mettez en cache les réponses approuvées pour réutilisation.

Quel est le premier flux de travail à automatiser le plus rapidement ?

De la réunion au backlog. Résumez les appels Teams, extrayez les décisions, rédigez les stories avec critères d’acceptation, et poussez-les dans Jira, Trello ou Asana. Cela démontre sa valeur en quelques jours et réduit immédiatement les changements de statut.

Comment gérons-nous les coûts à mesure que l’usage augmente ?

Mettez en œuvre des budgets de tokens par projet, orientez les tâches simples vers des modèles légers, contrôlez le coût par résultat dans Power BI, et déclenchez des alertes en cas de pics. Référez-vous aux guides actuels sur la tarification et les limites de taux pour éviter les surprises.

Quelle place occupent les outils de développement dans le schéma ?

Intégrez GitHub et Visual Studio pour que l’assistant rédige les descriptions de PR, vérifie la conformité aux politiques, et lie la documentation. L’objectif est une automatisation cohérente, révisable, qui accélère la livraison sans masquer les détails.

Quels signaux montrent qu’il est temps de passer à l’échelle au-delà du pilote ?

Coûts unitaires stables, amélioration de la précision des prévisions, baisse des taux de réouverture et satisfaction positive des parties prenantes. Quand trois de ces indicateurs persistent sur deux trimestres, emballez les modèles sous forme de blueprints et déployez à l’échelle.

-

Open Ai7 jours ago

Open Ai7 jours agoLibérer la puissance des Plugins ChatGPT : améliorez votre expérience en 2025

-

Open Ai6 jours ago

Open Ai6 jours agoMaîtriser l’ajustement fin de GPT : un guide pour personnaliser efficacement vos modèles en 2025

-

Open Ai6 jours ago

Open Ai6 jours agoComparer ChatGPT d’OpenAI, Claude d’Anthropic et Bard de Google : quel outil d’IA générative dominera en 2025 ?

-

Open Ai6 jours ago

Open Ai6 jours agoTarification de ChatGPT en 2025 : Tout ce que vous devez savoir sur les tarifs et abonnements

-

Open Ai6 jours ago

Open Ai6 jours agoLa suppression progressive des modèles GPT : à quoi les utilisateurs peuvent s’attendre en 2025

-

Modèles d’IA6 jours ago

Modèles d’IA6 jours agoModèles GPT-4 : Comment l’intelligence artificielle transforme 2025