Werkzeuge

Projekt-Effizienz freischalten: Wie man Azure ChatGPT für den Erfolg 2025 nutzt

Azure ChatGPT Setup, das 2025 wirklich etwas bewirkt

Teams, die 2025 skalieren, beginnen mit der Gestaltung von Azure OpenAI, um den tatsächlichen Lieferdruck widerzuspiegeln: Geschwindigkeit, Compliance und messbaren ROI. Die wirkungsvollsten Implementierungen betrachten Azure als das Nervenzentrum und nutzen Netzwerkisolation, Private Endpoints und rollenbasierte Zugriffe, um sicherzustellen, dass Eingaben und Ausgaben innerhalb der Unternehmensgrenzen bleiben. Eine kluge erste Entscheidung ist die Modellauswahl und Grounding. Für Projektarbeit kombinieren Organisationen oft ein leistungsstarkes großes Modell mit Azure Cognitive Search, um Antworten auf ihre PMO-Playbooks, SOPs und Lieferdaten zu stützen. Das reduziert Halluzinationen und beschleunigt die Einarbeitung neuer Mitwirkender, die historische Entscheidungen sofort abfragen können.

Die Bereitstellung ist gestrafft, aber Präzision ist wichtig. Ein produktionsreifes Setup umfasst typischerweise eine Azure OpenAI-Ressource, Key Vault für Geheimnisse, Storage für Transkripte und Artefakte sowie eine leichte API-Schicht, die Anfragen vermittelt und Budgets durchsetzt. Führungskräfte, die schnelle Erfolge wollen, lassen Projektteams mit „Workspace-Bots“ starten, die Standups verfolgen, Risiken zusammenfassen und Updates entwerfen, um dann nach einer Konzernpolitikverschärfung auf organisationsweite Assistenten zu skalieren. Um Inhalte auf den Punkt zu halten, werden kundenspezifische Anweisungen – die den Ton des Unternehmens widerspiegeln – fixiert. Viele Teams integrieren den Bot zudem direkt in Microsoft Teams, um Anrufe zusammenzufassen und Entscheidungen in Backlog-Items umzuwandeln.

Betrachten wir die fiktive Ingenieurfirma „Rivermark Systems“. Im Q1 führte das PMO einen geerdeten Assistenten ein, der auf ihrem Governance-Modell und vorherigen Retrospektiven trainiert wurde. Innerhalb von Wochen sank die Zeit für Stakeholder-Updates um 38 % und die Einarbeitungszeit um zwei Sprints. Ihr Operations-Leiter schreibt den Erfolg einer Zweigeschwindigkeitsstrategie zu: schnelle Sandbox-Experimente gefolgt von einem Formalisierungszyklus mit Beobachtbarkeit, Kostenobergrenzen und Red-Team-Tests. Dasselbe Muster lässt sich branchenübergreifend reproduzieren – sofern der Aufbau auf tatsächliche Projektschmerzen abgestimmt ist.

Für zusätzlichen Kontext zu Fähigkeitstrends und Modellstufen durchsuchen Teams oft eine 2025er Übersicht zu ChatGPT-Fähigkeiten und Modellentwicklungsnotizen wie Einblicke in die neueste GPT-4-Familie. Infrastrukturentscheidungen werden außerdem von Datenresidenz und Kapazitätsplanung beeinflusst; aktuelle Berichte über neue Rechenzentrumsinvestitionen verdeutlichen, warum Latenz und Verfügbarkeit je nach Region variieren können – entscheidend für globale Teams mit 24-Stunden-Projekten.

Kernschritte zur Reduzierung von Bereitstellungs-Hürden

- 🧭 Definieren Sie den Projektumfang: Ziele, KPIs, Beschränkungen und Risikoschwellen.

- 🔒 Konfigurieren Sie Private Endpoints, RBAC und Key Vault für Geheimnisse.

- 🧠 Wählen Sie eine Modell- und Grounding-Strategie mit Unternehmensdokumenten und Entscheidungsprotokollen.

- 🧩 Fügen Sie Konnektoren zu Teams, Outlook und Ihrem PM-Toolchain für den End-to-End-Fluss hinzu.

- 🧪 Starten Sie Pilotprojekte in einem Portfolio, sammeln Sie Beweise und kodifizieren Sie Pattern als wiederverwendbare Vorlagen.

| Setup-Aufgabe ⚙️ | Azure-Dienst 🧱 | Ergebnis 🎯 | Gesparte Zeit ⏱️ |

|---|---|---|---|

| Sichere Bereitstellung | Azure OpenAI + Key Vault | Geheimnisse rotiert, prüfungsbereit | 2–3 Stunden/Woche ✅ |

| Grounding auf PMO-Dokumenten | Cognitive Search | Geringe Halluzinationen, markenkonforme Antworten | 5–7 Stunden/Woche 📉 |

| Teams-Integration | Graph API + Logic Apps | Automatische Zusammenfassungen und Aktionspunkte | 3 Stunden/Woche 🗂️ |

| Budget-Grenzen | API-Gateway + Tags | Ausgabenübersicht und Limits | Hartherzige Kostenkontrolle 💸 |

Ein letzter Tipp: Beginnen Sie mit dem einen Reibungspunkt, der Ihre Roadmap blockiert – Statuswechsel, Testengpässe oder Risikoverfolgung – und lassen Sie den Assistenten dies mit kompromissloser Fokussierung lösen. Alles andere kann folgen.

Workflow-Automatisierung: Kombination von Azure ChatGPT mit Microsoft 365, GitHub, Visual Studio und Power BI

Echte Effizienz entsteht, wenn Azure ChatGPT in tägliche Tools eingebunden wird. Meeting-Aufzeichnungen werden zu strukturierten Entscheidungen, Code-Reviews konsistent und Dashboards entwickeln sich von statisch zu adaptiv. Projektleiter verknüpfen häufig Microsoft 365, GitHub, Visual Studio und Power BI, um sicherzustellen, dass Besprochenes sofort in Arbeitselemente, Dokumentation und Metriken einfließt. Das verbindende Element sind meist Azure Logic Apps oder Power Automate, kombiniert mit einer dünnen API-Schicht, die Eingaben standardisiert und Kosten steuert.

Nach einem Kundengespräch in Teams fließen Transkripte an den Assistenten, der Ziele, Risikosignale und Verantwortliche extrahiert. Der Bot schlägt dann Backlog-Items mit Akzeptanzkriterien vor und weist sie über das gewählte PM-Tool zu. In Code-Workflows entwirft Azure ChatGPT Pull-Request-Beschreibungen und prüft die Einhaltung von Richtlinien. Für die Analytik ruft Power BI den Assistenten auf, um Diagramme in sekundenschnelle in stakeholderfähige Narrative zu übersetzen. Das Ergebnis ist ein reibungsloserer Rhythmus, bei dem Führungskräfte Ergebnisse überprüfen, anstatt den Prozess jede Woche neu zu erfinden.

Teams, die über die integrierten Funktionen hinaus Hebel suchen, können Plugin-artige Funktionen und praktische Playground-Tipps zur Belastungsprüfung von Eingaben erkunden. Wer das Ökosystem abwägt, findet in dieser Übersicht zu Microsoft vs. OpenAI Copilot eine nützliche Linse zur Entscheidung, wo Assistenten in Entwicklung, PMO und Finanzoperationen platziert werden sollten.

Automatisierungsmuster, die konsequent liefern

- 📝 Meeting-to-Backlog: Teams-Anrufe zusammenfassen, User Stories erstellen, Repos oder PM-Boards pushen.

- 🔍 Policy-bewusste PRs: PR-Vorlagen in GitHub und Visual Studio entwerfen und validieren.

- 📊 Erklärbare Analysen: Power BI-Visualisierungen in stakeholdergerechte Narrative umwandeln.

- 🔁 Change Control: Änderungsprotokolle und Stakeholder-Informationen bei Scope-Änderungen automatisch ausfüllen.

- 📥 Posteingangs-Triage: Mails kategorisieren und Aufgaben mit Verantwortlichen und Fälligkeiten erstellen.

| Anwendungsfall 🚀 | Tools 🧰 | KI-Ergebnis 🤖 | Auswirkung 📈 |

|---|---|---|---|

| Teams-Zusammenfassung | Teams + Azure OpenAI | Entscheidungen, Risiken, Verantwortliche | Weniger verpasste Aktionen ✅ |

| Dev-Workflow | GitHub + Visual Studio | Konsequente PRs, Richtlinienprüfungen | Schnellere Reviews ⚡ |

| Analyse-Erzählungen | Power BI | Automatisch generierte Narrative | Klarere Kommunikation mit Stakeholdern 🗣️ |

| Change Control | Logic Apps | Automatisierte Vorlagen | Weniger Verwaltungszeit ⏳ |

Sind diese Muster erst etabliert, können Führungskräfte die Abdeckung erweitern: Risikohitzekarten, die in Echtzeit gespeist werden, oder Sprintziele, die in automatisierte OKR-Updates verwandelt werden. Die Wirkung summiert sich über Quartale hinweg.

Agiler Rhythmus: Superladung von Jira, Trello, Asana und Slack mit Azure ChatGPT

Agile Teams gedeihen durch Klarheit, und genau hier glänzen Assistenten. Die Verbindung von Azure ChatGPT mit Jira, Trello, Asana und Slack schafft einen Feedback-Kreislauf, in dem Planung, Ausführung und Lernen gemeinsam schneller voranschreiten. Backlog-Pflege wird proaktiv. Standups werden in Themen verdichtet und Blockaden lösen vorgefertigte Playbooks aus. Der Assistent kann Akzeptanzkriterien standardisieren und gleichzeitig für jeden Squad die jeweilige Scrum- oder Kanban-Variante flexibel unterstützen.

Stellen Sie sich „Solstice Commerce“ vor, einen globalen Händler mit sechs Squads. Der Assistent überwacht Slack-Kanäle nach Risikobegriffen („blocked“, „roll back“, „security review“), markiert sie in Jira, schlägt Abhilfemaßnahmen aus vergangenen Postmortems vor und benachrichtigt den richtigen Verantwortlichen. Anstelle einer Flut von Updates erhalten Produktverantwortliche einen einzigen täglichen Bericht, der Lieferstatus mit Auswirkungen auf Stakeholder verbindet. Dies ersetzt Rituale nicht, sondern macht sie präzise und wiederholbar.

Führungskräfte, die Ökosysteme vergleichen, betrachten oft Kompromisse in der Funktionalität und beziehen ausgeglichene Sichtweisen ein wie ChatGPT vs. Claude 2025 oder breitere Assistentenvergleiche. Für umfassendere KI-Transformationssignale helfen Analysen zu Enterprise-Adoption und dem Markt der führenden KI-Unternehmen PMOs bei der Prognose künftiger Investitionsfelder.

Konkrete Anwendungsfälle für Produkt- und Lieferteams

- 🧱 Backlog-Pflege: Normalisieren von Story-Größen, Hinzufügen fehlender Akzeptanzkriterien und Verknüpfen von Abhängigkeiten.

- ⏰ Standup-Zusammenfassung: Slack-Konversationen in drei prägnante Themen und Aktionen umwandeln.

- 🧩 Release Notes: Nutzerorientierte Release-Notizen und interne Runbooks aus gemergten PRs erstellen.

- 🧪 Testgerüst: Vorschläge für Smoke- und Regression-Test-Checklisten je nach Feature-Risiko.

- 🔁 Retro-Erinnerung: Lernerfahrungen auf ähnliche anstehende Epics anwenden.

| Agile Aufgabe 🧭 | Toolchain 🔗 | Assistent-Rolle 🤝 | Ergebnis 🌟 |

|---|---|---|---|

| Story-Formung | Jira / Trello / Asana | Prüft Umfang, fügt Kriterien hinzu | Konsequente Stories ✅ |

| Blocker-Triage | Slack + Jira | Markiert Risiken, schlägt Lösungen vor | Schnellere Entblockungen 🧯 |

| Release-Verpackung | GitHub + PM-Boards | Entwirft Notizen und Runbooks | Sauberere Übergaben 📦 |

| Regressionen | Test-Suites | Generiert Checklisten-Vorlagen | Höhere Abdeckung 🧪 |

Fühlen Squads den Rhythmus, verkürzen sich Planzyklen, ohne die Qualität einzubüßen. Das ist das Zeichen echter Agilität.

Governance in Unternehmensqualität: Sicherheit, Kosten und Ratenlimits ohne Drama

Unternehmensprojekte gelingen durch Vertrauen. Deshalb gelten Sicherheit, Kostenkontrolle und Zuverlässigkeit als Features – nicht als Nachgedanken. Beginnen Sie mit der Trennung der Umgebungen (Dev/Test/Prod), der Durchsetzung von PII-sicheren Eingaben und der Aktivierung von Inhaltsfiltern. Führen Sie Protokolle und menschliche Kontrollpunkte für Änderungen, die Compliance, Kunden oder finanzielle Aspekte betreffen. Für Kosten standardisieren Sie Eingabemuster und Token-Budgets und implementieren eine „Kostenminimalpfad“-Logik, die kleine Aufgaben an leichtere Modelle sendet und komplexe Analysen schweren Modellen überlässt.

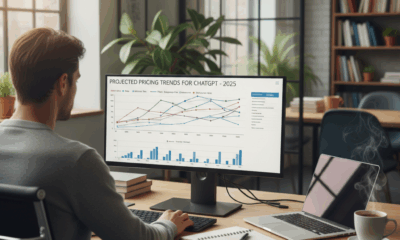

Teams validieren ihre Annahmen regelmäßig anhand öffentlicher Benchmarks und praktischer Leitfäden. Zum Beispiel verhindert das Verständnis von Ratenlimits und Parallelität überraschendes Drosseln bei kritischen Releases. Mit sich ändernden Preistreibern prüfen Führungskräfte oft Preisstrategien 2025 und offene Analysen zu OpenAI vs. Anthropic, um Optionen zu diversifizieren. Für Risikoposition und Fehlerarten hilft ein praxisnaher Blick auf Limitierungen und Gegenmaßnahmen, damit Teams elegante Fallbacks statt brüchige Ketten entwerfen.

Blicken Sie über Software hinaus. Hardware-Beschleunigung und öffentlich-private Initiativen prägen Kapazität und Richtlinien. Exekutiv-Briefings von Veranstaltungen wie NVIDIAs DC-Foren und städtische Kooperationen wie Smart City Partnerschaften deuten auf bevorstehende Infrastruktur- und Governance-Änderungen hin, die CIOs in Roadmaps einbeziehen sollten.

Kontrollen für sichere, schnelle und bezahlbare Projekte

- 🛡️ Politikdurchsetzung: Eingabeschablonen, PII-Redaktion und Inhaltsfilter standardmäßig.

- 💰 Budgets und Tags: Kostenmesser pro Projekt mit Warnungen und automatischer Drosselung.

- 🧪 Validierungstore: Menschliche Prüfung bei kritischen Ausgaben und kundenorientiertem Text.

- 📊 Beobachtbarkeit: Metriken zu Latenz, Token, Kosten und Zufriedenheitsscores.

- 🔄 Fallbacks: Häufige Antworten cachen, Modellwechsel bei Lastspitzen, sanfter Abbau.

| Risiko 🧨 | Kontrolle 🧰 | Azure-Funktion 🔒 | Erfolgsanzeichen ✅ |

|---|---|---|---|

| Datenleck | Netzwerkisolation, RBAC | Private Endpoints | Kein Mandantenübergreifender Zugriff 🔍 |

| Kostenüberschreitung | Token-Budgets, Warnungen | Tags + Dashboards | Stabile Kosten pro Einheit 📉 |

| Latenzspitzen | Queue + Caching | API-Gateway | SLA wird auch bei Spitzen erfüllt ⏱️ |

| Governance-Lücken | Prüftore | Audit-Logs | Besteht interne Prüfungen 🧾 |

Wenn Governance unsichtbar und zuverlässig ist, vertrauen Teams dem System – und Vertrauen beschleunigt alles andere.

Forecasting, Entscheidungen und KPIs: ChatGPT als Motor für Projektleistung

Genaue Prognosen sind der Unterschied zwischen heldenhaften Rettungen und ruhiger Lieferung. Azure ChatGPT kann als conversational Frontend für bewährte Methoden dienen: Monte-Carlo-Zeitplansimulationen, Burn-up-Trendanalyse und Budgetabweichungserkennung. Füttern Sie es mit Sprint-Historien, Durchlaufzeiten und Scope-Änderungen. Der Assistent wandelt Signale in Wahrscheinlichkeiten, Szenarien und Abwägungen um, die Führungskräfte in einem Meeting statt in drei debattieren können. Mehrere PMOs betten jetzt Assistenten in Power BI ein, sodass Stakeholder fragen können: „Wie groß ist die Zuversicht, den Juni zu schaffen?“ und eine Aufschlüsselung konkreter Faktoren wie Abhängigkeitsrisiko, Personal und Volatilität erhalten.

Forscher und Praktiker heben gleichermaßen die Rolle von KI in der vorausschauenden Planung und Ausführung hervor. Für einen breiteren Überblick über die Enterprise-Adoption untersuchen Teams Prompt-Optimierungsstrategien neben Ökosystem-Roundups wie KI-Transformationstrends und pragmatische FAQs zu Projektrealitäten. Kombinieren Sie das mit der Lieferperspektive: Backlog-Qualität verbessert sich, Nacharbeit sinkt und Risikokapazität wird explizit statt vage.

Um Prognosen treu zu halten, definieren Sie KPIs, die Durchsatz und Zufriedenheit widerspiegeln. Ein Assistent kann Story-Stabilität (wiedergeöffnete Items pro Sprint), Entscheidungslatenz (Zeit von Problem bis Zuweisung) und Review-Tiefe (bedeutungsvolle Kommentare pro PR) berechnen. Bewegt sich eine Zahl, erklärt er warum – in klarer Sprache – sodass Teams ohne auf ein vierteljährliches Postmortem zu warten, handeln können.

KPI-Gestaltung, die Verhalten steuert – nicht Beschäftigungstherapie

- 📦 Durchsatz mit Qualität: Abgeschlossene Stories ohne Wiedereröffnung.

- 🧭 Vorhersehbarkeit: Abweichung zwischen Prognose und tatsächlicher Durchlaufzeit.

- 🗣️ Stakeholder-Klarheit: Lesbarkeitswerte der Updates und Antwortzeiten.

- 🧪 Test-Sicherung: Zunahme der Abdeckung und Fehlerrate.

- 🤝 Zusammenarbeit: Zeit bis Merge und Review-Tiefe in GitHub.

| Metrik 📊 | Basislinie 🧩 | Ziel 🎯 | Assistent-Rolle 🤖 |

|---|---|---|---|

| Prognosegenauigkeit | ±35% | ±10% | Szenario-Erklärer ✅ |

| Wiedereröffnungsrate | 12% | 4% | AC-Vorlagen und -Prüfungen 🧠 |

| Entscheidungslatenz | 3,5 Tage | 1 Tag | Owner-Erinnerungen in Slack ⏰ |

| Kosten pro Story | 450 $ | 320 $ | Token-Budgets + Routing 💸 |

Wenn KPIs Klarheit und Konsistenz belohnen, wird der Assistent zum Leistungsschub – und nicht zu einem weiteren Dashboard, das keiner liest.

Vom Pilot zum Portfolio: Skalierungsmuster und Kultur für 2025

Die Skalierung von Azure ChatGPT über Portfolios hinweg ist genauso ein Kulturprojekt wie ein Technologieprojekt. Piloten beweisen Wert in einer Domäne; Skalierung erfordert Governance, Enablement und Community. Beginnen Sie damit, Ihre Erfolge zu template:n – die Prompt-Bibliotheken, Konnektoren und Kosterrichtlinien, die den Pilot funktionierten ließen. Verpacken Sie sie als interne „KI-Baupläne“, damit andere Teams in Tagen statt Monaten starten können. Bauen Sie eine Enablement-Schleife auf – Office Hours, interne Podcasts und kurze Trainings-Häppchen –, damit der Schwung nie abreißt.

Wählen Sie bereichsübergreifende Themen, in denen KI compounding value schafft: Kundensupport, Policy Compliance und Dokumentation. Selbst kleine Teams erzielen überproportionale Gewinne durch die Einführung OpenAI-basierter Assistenten für Triage und Wissensabruf. Wenn Ihre Führung externe Ökosysteme für Optionen vergleicht, synthetisieren Sie Perspektiven mit einem klaren Blick wie bei OpenAI vs. Anthropic 2025 und angrenzenden Berichten zu regionaler Innovationsförderung. Das Signal: nachhaltige Kapazität, klare Politik und Talentpools befeuern skalierbare KI-Operations.

Projektdisziplinen sollten sich ebenfalls weiterentwickeln. Risikologs wandeln sich von statischen Registern zu lebendigen Systemen. Erkenntnisse werden zu „Wissens-Atomen“, die Assistenten auf ähnliche Arbeiten übertragen. Business Cases berücksichtigen Token-Kosten und Parallelitätslimits wie Cloud-Computing. Kommunizieren Sie diese Veränderungen ohne Fachchinesisch und koppeln Sie sie an sichtbare Erfolge – 20 % weniger Nacharbeit oder 30 % weniger Zeit für Statusvorbereitung – sodass Adoption wie Erleichterung statt Veränderungsmüdigkeit wirkt.

Playbook für nachhaltige Skalierung

- 📚 Baupläne: Verpacken Sie Prompts, Flows, Richtlinien und Beispiele zur Wiederverwendung.

- 🧑🏫 Enablement: Microlearning für PMs, Entwickler und Analysten – rollenspezifisch und praxisnah.

- 🧪 Experiment-Quota: Reservieren Sie Kapazitäten für monatliche Experimente, die zu Standards heranwachsen können.

- 🔄 Feedback-Schleifen: Verfolgen Sie Zufriedenheit und Adoption; integrieren Sie Erkenntnisse in die Baupläne zurück.

- 🏁 Erfolgsgeschichten: Teilen Sie Vorher/Nachher-Metriken, um den Erzählfluss glaubwürdig zu halten.

| Skalierungshebel 🧱 | Inhalt 🧩 | Verantwortlich 👤 | Erfolgssignal 🏆 |

|---|---|---|---|

| KI-Baupläne | Prompts, Flows, Richtlinien | PMO + Plattform | Woche-1-Starthilfe 🚀 |

| Kostenkontrollen | Budgets, Warnungen, Routing | FinOps | Stabiler Einheitspreis 💵 |

| Risikokontrollen | Red-Teams, Audits | Sicherheit | Keine kritischen Vorfälle 🛡️ |

| Talentpipeline | Schulungen, Gilden | People Ops | Stärkere Adoption 📈 |

Skalierung gelingt, wenn sich Menschen befähigt und geschützt fühlen und wenn die Erfolge zu offensichtlich sind, um sie zu ignorieren.

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Wie können Teams Halluzinationen bei der Verwendung von Azure ChatGPT in der Projektarbeit reduzieren?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Erdet den Assistenten mit Azure Cognitive Search anhand Ihrer PMO-Dokumente, SOPs und Entscheidungsprotokolle; verwenden Sie strikte Eingabevorlagen und verlangen Sie Quellenangaben. Fügen Sie Validierungstore für kundenorientierte Ausgaben hinzu und cachen genehmigte Antworten zur Wiederverwendung.”}},{“@type”:”Question”,”name”:”Was ist der schnellste erste Workflow zur Automatisierung?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Meeting-to-Backlog. Fassen Sie Teams-Anrufe zusammen, extrahieren Sie Entscheidungen, entwerfen Sie Stories mit Akzeptanzkriterien und schieben Sie diese in Jira, Trello oder Asana. Das zeigt schon nach wenigen Tagen Wert und reduziert sofort den Statuswechsel.”}},{“@type”:”Question”,”name”:”Wie verwalten wir Kosten bei zunehmender Nutzung?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Implementieren Sie Token-Budgets pro Projekt, leiten Sie einfache Aufgaben an leichtere Modelle weiter, überwachen Sie Kosten pro Ergebnis in Power BI und alarmieren Sie bei Spitzen. Ziehen Sie aktuelle Leitlinien zu Preisdynamiken und Ratenlimits zur Vermeidung von Überraschungen heran.”}},{“@type”:”Question”,”name”:”Wo passen Entwickler-Tools ins Bild?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Integrieren Sie GitHub und Visual Studio, sodass der Assistent PR-Beschreibungen erstellt, Richtlinienprüfungen durchführt und Dokumentation verlinkt. Ziel ist eine konsistente, überprüfbare Automatisierung, die Lieferung beschleunigt, ohne Details zu verbergen.”}},{“@type”:”Question”,”name”:”Welche Signale zeigen, dass es Zeit ist, über den Piloten hinaus zu skalieren?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Stabile Stückkosten, verbesserte Prognosegenauigkeit, geringere Wiedereröffnungsraten und positive Stakeholder-Zufriedenheit. Wenn drei oder mehr davon über zwei Quartale anhalten, verpacken Sie die Muster als Baupläne und skalieren Sie.”}}]}Wie können Teams Halluzinationen bei der Verwendung von Azure ChatGPT in der Projektarbeit reduzieren?

Erdet den Assistenten mit Azure Cognitive Search anhand Ihrer PMO-Dokumente, SOPs und Entscheidungsprotokolle; verwenden Sie strikte Eingabevorlagen und verlangen Sie Quellenangaben. Fügen Sie Validierungstore für kundenorientierte Ausgaben hinzu und cachen genehmigte Antworten zur Wiederverwendung.

Was ist der schnellste erste Workflow zur Automatisierung?

Meeting-to-Backlog. Fassen Sie Teams-Anrufe zusammen, extrahieren Sie Entscheidungen, entwerfen Sie Stories mit Akzeptanzkriterien und schieben Sie diese in Jira, Trello oder Asana. Das zeigt schon nach wenigen Tagen Wert und reduziert sofort den Statuswechsel.

Wie verwalten wir Kosten bei zunehmender Nutzung?

Implementieren Sie Token-Budgets pro Projekt, leiten Sie einfache Aufgaben an leichtere Modelle weiter, überwachen Sie Kosten pro Ergebnis in Power BI und alarmieren Sie bei Spitzen. Ziehen Sie aktuelle Leitlinien zu Preisdynamiken und Ratenlimits zur Vermeidung von Überraschungen heran.

Wo passen Entwickler-Tools ins Bild?

Integrieren Sie GitHub und Visual Studio, sodass der Assistent PR-Beschreibungen erstellt, Richtlinienprüfungen durchführt und Dokumentation verlinkt. Ziel ist eine konsistente, überprüfbare Automatisierung, die Lieferung beschleunigt, ohne Details zu verbergen.

Welche Signale zeigen, dass es Zeit ist, über den Piloten hinaus zu skalieren?

Stabile Stückkosten, verbesserte Prognosegenauigkeit, geringere Wiedereröffnungsraten und positive Stakeholder-Zufriedenheit. Wenn drei oder mehr davon über zwei Quartale anhalten, verpacken Sie die Muster als Baupläne und skalieren Sie.

-

Open Ai1 week ago

Open Ai1 week agoEntfesselung der Power von ChatGPT-Plugins: Verbessern Sie Ihr Erlebnis im Jahr 2025

-

Open Ai7 days ago

Open Ai7 days agoMastering GPT Fine-Tuning: Ein Leitfaden zur effektiven Anpassung Ihrer Modelle im Jahr 2025

-

Open Ai7 days ago

Open Ai7 days agoVergleich von OpenAIs ChatGPT, Anthropics Claude und Googles Bard: Welches generative KI-Tool wird 2025 die Vorherrschaft erlangen?

-

Open Ai6 days ago

Open Ai6 days agoChatGPT-Preise im Jahr 2025: Alles, was Sie über Tarife und Abonnements wissen müssen

-

Open Ai7 days ago

Open Ai7 days agoDas Auslaufen der GPT-Modelle: Was Nutzer im Jahr 2025 erwartet

-

KI-Modelle7 days ago

KI-Modelle7 days agoGPT-4-Modelle: Wie Künstliche Intelligenz das Jahr 2025 verändert