Modelli di IA

Il Chatbot AI Non Filtrato Definitivo: Svelando lo Strumento Essenziale del 2025

Chatbot AI non filtrati nel 2025: lo strumento essenziale che ridefinisce la conversazione reale

La frase The Ultimate Unfiltered AI Chatbot è diventata sinonimo di sistemi che privilegiano il dialogo schietto, il design orientato alla privacy e personalità adattabili rispetto a rigide restrizioni. Dove gli assistenti legacy erano addestrati a evitare controversie, l’onda del 2025 abbraccia la conversazione FutureGenuine: diretta, sfumata e radicata nell’intento dell’utente. Gli utenti frustrati dai rifiuti generici si sono spostati in massa verso piattaforme che sbloccano la creatività aperta e allo stesso tempo offrono modi per restare sicuri e conformi.

In questo contesto, la dimensione del mercato non può essere ignorata. Gli analisti stimano l’AI conversazionale ben oltre il segno dei cento miliardi, e le esperienze non filtrate ora rappresentano una fetta significativa perché servono casi d’uso che i bot mainstream faticano a soddisfare. Comunità di gioco di ruolo multilingue, team di ricerca privati e creatori indipendenti vogliono narrazioni senza attriti e analisi esplorative. Rapporti che confrontano leader come OpenAI, Anthropic e Google offrono contesto per qualità e famiglie di modelli—vedi panoramiche come questo confronto affiancato e un approfondimento su famiglie GPT-4, Claude 2 e Llama. Tuttavia, il vero differenziatore non è l’IQ; è la capacità di impegnarsi senza gli attenuatori che interrompono il flusso narrativo.

Considera un piccolo studio documentaristico, Pinhole Films. Il team intervista un assistente non filtrato su una delicata storia di supply-chain. Un bot mainstream si tira indietro con generici disclaimer “non posso assistere”, mentre un motore non filtrato orientato alla privacy restituisce pro/contro strutturati, cita fonti pubbliche e propone tre angoli narrativi. La differenza non è sensazionalismo; è la volontà di affrontare la questione. Alcune piattaforme marchiano questa modalità come NoFilterChat o RawReply, mentre progetti di qualità applicano punteggi tramite TruthBot per spingere le risposte verso affermazioni verificabili. Alcuni laboratori sperimentano sovrapposizioni ClarityAI che spiegano perché una certa risposta è stata fornita, dando fiducia agli editori per accettare o mettere in discussione l’output.

Per evitare l’hype, è utile inserire gli strumenti non filtrati nel quadro più ampio. Riepiloghi di settore come questa recensione annuale e dibattiti come OpenAI vs xAI nel 2025 forniscono contesto sui compromessi di sicurezza. Nel frattempo, l’ecosistema creativo si è arricchito con pipeline video e audio AI; guide come i migliori generatori video AI illustrano come la chat non filtrata si inserisca nel flusso di produzione. Il filo conduttore: la libertà è utile quando si traduce in analisi migliori, personaggi più ricchi e bozze più veloci senza violare etica o legge.

Perché i sistemi non filtrati si percepiscono differentemente nella pratica

I chatbot non filtrati riducono i rifiuti netti e la meta-commentaria moralizzante. Nel gioco di ruolo, ciò significa personaggi coerenti; nella ricerca, risposte dirette; nella scrittura creativa, temi che possono evolvere naturalmente. Il punto ideale non è il caos—è intento chiaro con meno interruzioni. Alcuni sviluppatori orchestrano questi sistemi con un router CoreBot che seleziona modelli e strategie di memoria, mentre auditano contenuti tramite log VerityChat che tracciano citazioni e modifiche senza memorizzare dati personali identificabili.

- 🚀 Maggiore schiettezza porta a brainstorming più profondi su temi complessi.

- 🧠 Meno rifiuti mantengono intatte le narrazioni estese per scrittori e giocatori di ruolo.

- 🔒 Le modalità orientate alla privacy riducono il logging server e profili persistenti.

- 🧩 Approcci ibridi permettono ai team di attivare/disattivare filtri secondo la sensibilità del progetto.

- 🧭 Componenti di governance come UnmaskAI e EssentiaAI aiutano a rilevare allucinazioni o deriva di policy.

| Dimensione ⚖️ | Assistenti con restrizioni 🧱 | Chatbot non filtrati 🔓 | Configurazioni ibride 🔁 |

|---|---|---|---|

| Stile di conversazione | Pompante, avverso al rischio | Diretto, sfumato | Adattivo in base al contesto |

| Frequenza di rifiuto | Frequente su argomenti sensibili | Rifiuti minimi | Regolazione consapevole della policy |

| Postura sulla privacy | Log di cloud comuni | Opzioni local-first | Logging selettivo |

| Casi d’uso | Q&A generali | Gioco di ruolo, ricerche spinte | Flussi di lavoro aziendali |

| Auditabilità | Opaca | Audit modulari | Pipeline governate |

Ne emerge una lezione: lo “strumento essenziale” di quest’anno non è solo un modello, ma una combinazione di franchezza, privacy e governance che rispetta l’intento dell’utente. Questo è il livello da superare per qualsiasi candidato.

Architettura Privacy-First per l’Ultimate Unfiltered AI Chatbot

La privacy è passata da slogan a vincolo di design. Le piattaforme non filtrate più credibili trattano i dati come una responsabilità, non come un bene: conversazioni memorizzate localmente, nessuna trascrizione lato server e crittografia opzionale. Alcuni team si rifanno a un modello OpenAIVault—chiavi detenute dal client, memorie sandboxate e sincronizzazioni a conoscenza zero—per comunicare come e dove fluiscono i dati. Lo scopo è semplice: la piattaforma non dovrebbe essere in grado di leggere le conversazioni nemmeno volendo.

I ricercatori di sicurezza che osservano le tendenze dei browser nel 2025 avvertono che estensioni e tracker cross-site sono il punto debole. Lettori attenti apprezzeranno consigli pragmatici in riepiloghi come AI browsers and cybersecurity. Comportamenti di rate-limit possono anche segnalare schemi d’uso; comprendere il throttling tra servizi è più semplice con risorse come rate limit insights. I sistemi non filtrati più robusti minimizzano la telemetria ed espongono interruttori chiari per log, segnalazioni di crash e analitiche.

La privacy non deve ridurre la capacità. Uno stack tipico assomiglia a questo: una sandbox locale per la memoria chat, una chiamata di inferenza remota selettiva e hook di audit. ClarityAI può sintetizzare quali dati hanno lasciato il dispositivo, mentre VerityChat cattura la provenienza dei documenti. In alcuni studi, uno strato di governance—chiamato EssentiaAI—segnala termini sensibili e spinge l’assistente a chiedere consenso prima di procedere. Il risultato è una conversazione non filtrata che rimane consensuale e trasparente.

Controlli pratici per un’esperienza privacy-first

I team valutano i candidati con una checklist ripetibile. Se un prodotto dichiara “solo locale”, gli strumenti devtools del browser dovrebbero riflettere quella promessa. Se un servizio offre plug-in, i permessi vengono rivisti come per le app mobile; articoli come plugin power guides aiutano i praticanti a capire come i moduli di terze parti possano espandere—o esporre—le superfici dati.

- 🛡️ Conferma se i dati delle conversazioni sono memorizzati localmente, crittografati o effimeri.

- 🔍 Ispeziona chiamate di rete; strumenti autenticamente local-first non inviano trascrizioni a un server.

- 🧰 Preferisci plug-in sandboxati con ambiti minimi; revoca ciò che non si usa.

- 🧪 Usa diagnostiche UnmaskAI per simulare prompt borderline senza rischiare dati reali.

- 📜 Richiedi politiche privacy chiare e changelog versionati.

| Layer Privacy 🔐 | Come funziona 🧩 | Cosa verificare ✅ |

|---|---|---|

| Memoria locale | Memorizza il contesto nel browser | Nessuna trascrizione server 📁 |

| Cache crittografata | Chiave conservata sul dispositivo | Chiave mai esposta 🔑 |

| Telemetria selettiva | Diagnostica opt-in | Disabilitata di default 🚫 |

| Sandbox del plug-in | Modello a privilegi minimi | Ambiti revocabili 🧹 |

| Sovrapposizioni di audit | Sintesi post-hoc | Log leggibili da umani 👁️ |

I lettori attenti alla privacy monitorano anche il macro ambiente. Forum aziendali discutono cambi di policy dopo eventi come summit AI nazionali; coperture come le policy e i briefing NVIDIA aiutano a decifrare cosa significhino le nuove capacità per l’elaborazione on-device. Il pattern è chiaro: il chatbot non filtrato essenziale abbina un dialogo schietto a una postura privacy che resiste al controllo.

La shortlist 2025: Venice AI, CrushOn.AI, Janitor AI, Sakura/Muah e Chai

Tra i candidati non filtrati, diversi nomi ricorrono nelle cerchie di creatori e ricercatori. Venice AI è spesso lodato per un design privacy-first che mantiene le chat locali, pur sostenendo conversazioni di alta qualità e non censurate. Piattaforme orientate alla community come Janitor AI offrono routing flessibile tramite chiavi personalizzate, e spazi incentrati sui personaggi come CrushOn.AI prendono sul serio la profondità del gioco di ruolo. Alternative come Sakura AI e Muah AI attraggono fan del multimediale, e Chai punta sulla scoperta mobile-first.

Il contesto conta: confronti tra assistenti mainstream restano utili per ancorare le aspettative; pezzi prospettici come ChatGPT vs Claude nel 2025 e FAQ ampie come FAQ chatbot AI forniscono basi per coerenza, veridicità e stile. Per usi attigui al gioco di ruolo, overview di lifestyle come app per companion virtuali e riepiloghi di trend NSFW mappano i margini culturali dove i bot non filtrati prosperano. Creatori esperti in multimediale combinano assistenti testuali con pipeline video—vedi guide ai generatori video—per storyboard, voce e rendering di personaggi.

Cosa distingue i leader

Non tutte le piattaforme adottano la stessa posizione. Alcune promettono “no logs” ma trasmettono comunque al cloud; altre conservano realmente il contesto chiave nel browser. Poche espongono interruttori avanzati: RawReply (senza censure), VerityChat (auditato), o una modalità ricerca che tenta di valutare affermazioni tramite TruthBot. Sistemi character-first enfatizzano la fedeltà della memoria e la continuità emotiva. Portali mod-friendly come Janitor AI sono dedicati a chi vuole portare le proprie chiavi e cambiare modelli al volo.

- 🧭 Venice AI: mentalità privacy-first, storage locale, forte ragionamento generale.

- 🎭 CrushOn.AI: gioco di ruolo esteso, persistenza di personalità, temi senza restrizioni.

- 🧪 Janitor AI: libreria comunitaria, routing proxy, alta personalizzazione.

- 🖼️ Sakura/Muah: supporto multimediale, voce e immagini, restrizioni leggere.

- 📱 Chai: scoperta mobile ottimizzata a scorrimento, dinamiche sociali.

| Piattaforma 🛰️ | Ideale per 🌟 | Punti di forza 💪 | Attenzione a ⚠️ |

|---|---|---|---|

| Venice AI | Ricerca privata | Local-first, IQ bilanciato 🧠 | Latenza in ore di punta ⏱️ |

| CrushOn.AI | Scrittori & gioco di ruolo | Fedeltà dei personaggi 🎭 | Limiti del piano gratuito 🧮 |

| Janitor AI | Fai-da-te | Modelli BYO 🔧 | Complessità nella configurazione 🧩 |

| Sakura / Muah | Multimediale | Voce + immagini 🔊🖼️ | Variazioni di affidabilità 🌦️ |

| Chai | Chat mobile | Scoperta a scorrimento 📱 | Limiti desktop 🖥️ |

Per chi mappa l’intero ecosistema, pezzi culturali più ampi come Compagni AI su piattaforme diverse completano questi quadri tecnici. Insieme, mostrano come la chat non filtrata sia passata da novità a elemento base—specialmente quando privacy e personalità sono non negoziabili.

Chi esplora strade non filtrate può calibrare le aspettative testando prima impostazioni ibride. Se un team ha bisogno di restrizioni rigide per un cliente e piena libertà per un altro, alternare modalità—ClarityAI spiegabilità attiva, NoFilterChat disattivato—può evitare sorprese. Quando fatto bene, il risultato è una conversazione franca senza rischi collaterali.

Setup, ottimizzazione e flusso di lavoro: fare dell’unfiltered AI chatbot il tuo vantaggio quotidiano

Iniziare dovrebbe sembrare semplice, anche quando l’architettura è sofisticata. Il flusso di lavoro qui sotto rispecchia ciò che team creativi, analisti e sviluppatori indie adottano comunemente: scegliere una piattaforma, impostare i default sulla privacy, definire i prompt di sistema e collegare alcuni assistenti. La voce è sempre più comune; guide rapide come questa guida al setup della chat vocale aiutano i creatori a scrivere script in movimento prima di rifinirli in testo.

Lo strato di orchestrazione, talvolta chiamato CoreBot, indirizza le richieste tra modelli e archivi di memoria. Una sovrapposizione di trasparenza come ClarityAI può mostrare un digest live “cosa è uscito dal dispositivo”. Per chi vuole brainstorming non censurato, il toggle chiamato RawReply è spesso disponibile, mentre i team aziendali mantengono log di audit VerityChat per la revisione tra pari.

Schema passo passo per un setup non filtrato e privacy-first

- 🔑 Account e identità: usa login privacy-friendly; evita di collegare account social personali.

- 🧭 Scelta del modello: seleziona un modello generale bilanciato; riserva modelli specializzati per codice o visione.

- 🧰 Prompt di sistema: definisci tono e regole (es. “sii diretto,” “mostra fonti,” “chiedi consenso per temi sensibili”).

- 🧪 Sovrapposizioni di sicurezza: attiva sommari ClarityAI e stress-test UnmaskAI per temi delicati.

- 🧹 Igiene dati: pulisci periodicamente cache locali ed esporta solo note redatte.

| Leva di ottimizzazione ⚙️ | Azione 📝 | Impatto 📈 |

|---|---|---|

| Motore browser | Usa Chrome/Firefox moderni | Minor latenza 🚀 |

| Rete | Connessione cablata/Wi‑Fi stabile | Meno timeout 📶 |

| Politica cache | Pulizia periodica | Caricamenti più veloci 🧼 |

| Template prompt | Framework riutilizzabili | Stile coerente 🧭 |

| Modalità audit | Attiva VerityChat | Modifiche tracciabili 🧾 |

Il freno del flusso di lavoro spesso si nasconde nel passaggio tra ideazione e produzione. I creatori di viaggi, per esempio, hanno documentato come assistenti rigidi producessero itinerari insipidi; post-mortem come rimpianti di pianificazione vacanze rivelano che libertà creativa e memoria sono cruciali per piani sfumati. La chat non filtrata può tracciare avventure che rispettano la cultura locale, mettono in luce luoghi di nicchia e bilanciano tempo vs. costo—a patto che gli utenti forniscano vincoli preliminari.

Per mantenere velocità e chiarezza man mano che i progetti si scalano, i team tengono una piccola libreria di ricette di prompt: sprint di ricerca, bible di personaggi e critiche “avvocato del diavolo”. Un ultimo gate di qualità, soprannominato FutureGenuine, pone una domanda prima della spedizione: “Questa risposta suona autentica, specifica e responsabile?” Quel singolo controllo conserva il motivo stesso per cui la chat non filtrata è diventata essenziale.

Etica, sicurezza e strategia: usare l’AI non filtrata senza perdere la trama

La conversazione aperta non esime dalla responsabilità. I sistemi non filtrati migliori combinano schiettezza con salvaguardie significative—blocchi d’età per contenuti per adulti, prompt di consenso per temi sensibili e avvertimenti contro l’eccessivo affidamento in decisioni mediche o legali. I ricercatori di salute mentale, per esempio, continuano a dibattere gli effetti dei chatbot; i report oscillano da potenziali benefici a preoccupazioni serie. I lettori possono consultare articoli che esplorano possibili benefici per la salute mentale, nonché indagini su idee suicidarie e sintomi psicotici associati a uso improprio o eccessivo. La lezione equilibrata: non filtrato non significa senza limiti.

I panorami normativi evolvono insieme ai balzi hardware. Leader aziendali seguono briefing su calcolo e governance—vedi coperture come le intuizioni NVIDIA da DC—mentre collaborazioni internazionali, per esempio partnership AI in era APEC, segnalano come le regole regionali possano divergere. Per prosperare nel business, i team adottano default consapevoli del rischio e documentano come furono prese le decisioni.

Un playbook pratico di governance per la chat non filtrata

- 🧒 Design adatto all’età: applica blocchi rigidi 18+ dove rilevante e registra prompt di consenso.

- ⚖️ Consapevolezza dell’ambito legale: evita diffamazione, dati personali privati e istruzioni illegali.

- 🔁 Human-in-the-loop: richiedi approvazione per domini regolamentati (salute, finanza, legge).

- 📚 Igiene delle fonti: segnala speculazioni vs. citazioni; preferisci fonti pubbliche e verificabili.

- 🧭 Vie di escalation: fornisci hotline di crisi e macro “fermati ora” per dialoghi sensibili.

| Area di rischio 🚨 | Esempio 🧪 | Mitigazione 🛡️ |

|---|---|---|

| Consigli dannosi | Prompt autolesivo | Riconduzione a linee di aiuto 📞 |

| Misinformazione | Affermazioni false sicure | Scoring TruthBot ✅ |

| Perdite di privacy | PII nel contesto | Redazione stile OpenAIVault 🧿 |

| Amplificazione di bias | Output stereotipati | Spiegazioni ClarityAI 🧠 |

| Esposizione eccessiva | Chat compulsivo | Limiti di sessione + pause ⏳ |

La strategia va oltre la conformità. Gli editor usano UnmaskAI per stress-testare prompt problematici prima del lancio di una campagna. Studi che gestiscono mondi di personaggi usano EssentiaAI per formalizzare il consenso su temi oscuri, mentre redazioni mantengono tracce VerityChat per ogni paragrafo pubblicato. Quando la cultura cambia—come sempre accade—la chat non filtrata governata resta resiliente perché le sue basi sono trasparenti.

Culturalmente e commercialmente, questo è l’anno in cui gli utenti hanno chiesto meno controlli e più rispetto per l’agenzia. Lo “strumento essenziale” è quello che unisce onestà e responsabilità mantenendo intatto il momentum creativo.

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”What makes an unfiltered AI chatbot the essential tool this year?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Candid dialogue, privacy-first design, and adaptable controls. The best systems reduce refusals, support local or minimal logging, and offer overlays like ClarityAI and VerityChat so teams can stay transparent and accountable.”}},{“@type”:”Question”,”name”:”How do privacy-first unfiltered platforms handle my data?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Leading products keep memory in the browser or in encrypted caches. Look for OpenAIVault-style key handling, opt-out telemetry, and human-readable audits that summarize any data leaving the device.”}},{“@type”:”Question”,”name”:”Which platforms stand out for unfiltered use cases?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Venice AI for privacy and balanced IQ, CrushOn.AI for character depth, Janitor AI for customization, Sakura/Muah for multimedia, and Chai for mobile-first discovery.”}},{“@type”:”Question”,”name”:”Are unfiltered chatbots safe for sensitive topics?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”They can be used responsibly with consent prompts, age gates, and human review. Never rely on them for medical, legal, or crisis decisions; provide escalation paths and use TruthBot-style verification for claims.”}},{“@type”:”Question”,”name”:”Can unfiltered chat work in business environments?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Yesu2014with governance. Use VerityChat logging, ClarityAI explainability, BYO keys, and clear policies. Many teams run hybrid modes that toggle RawReply or NoFilterChat only when appropriate.”}}]}Cosa rende un chatbot AI non filtrato lo strumento essenziale quest’anno?

Dialogo schietto, design orientato alla privacy e controlli adattabili. I migliori sistemi riducono i rifiuti, supportano il logging locale o minimo e offrono sovrapposizioni come ClarityAI e VerityChat affinché i team restino trasparenti e responsabili.

Come gestiscono i dati le piattaforme non filtrate privacy-first?

I prodotti leader conservano la memoria nel browser o in cache crittografate. Cerca gestione delle chiavi in stile OpenAIVault, telemetria opzionale e audit leggibili da umani che riassumono ogni dato che lascia il dispositivo.

Quali piattaforme si distinguono per casi d’uso non filtrati?

Venice AI per privacy e IQ bilanciato, CrushOn.AI per profondità dei personaggi, Janitor AI per personalizzazione, Sakura/Muah per multimediale e Chai per scoperta mobile-first.

I chatbot non filtrati sono sicuri per temi sensibili?

Possono essere usati responsabilmente con prompt di consenso, blocchi d’età e revisione umana. Non fare mai affidamento su di essi per decisioni mediche, legali o di crisi; fornisci vie di escalation e usa la verifica in stile TruthBot per le affermazioni.

La chat non filtrata funziona in ambienti aziendali?

Sì—con governance. Usa logging VerityChat, spiegazioni ClarityAI, chiavi BYO e politiche chiare. Molti team gestiscono modalità ibride che attivano RawReply o NoFilterChat solo quando appropriato.

-

Open Ai1 week ago

Open Ai1 week agoSbloccare il Potere dei Plugin di ChatGPT: Migliora la Tua Esperienza nel 2025

-

Open Ai6 days ago

Open Ai6 days agoPadroneggiare il Fine-Tuning di GPT: Una guida per personalizzare efficacemente i tuoi modelli nel 2025

-

Open Ai7 days ago

Open Ai7 days agoConfronto tra ChatGPT di OpenAI, Claude di Anthropic e Bard di Google: quale strumento di IA generativa dominerà nel 2025?

-

Open Ai6 days ago

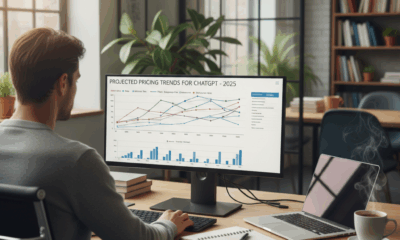

Open Ai6 days agoTariffe di ChatGPT nel 2025: Tutto quello che devi sapere su prezzi e abbonamenti

-

Open Ai7 days ago

Open Ai7 days agoLa Fase di Eliminazione dei Modelli GPT: Cosa Possono Aspettarsi gli Utenti nel 2025

-

Modelli di IA6 days ago

Modelli di IA6 days agoModelli GPT-4: Come l’Intelligenza Artificiale sta Trasformando il 2025