Open Ai

Die Erforschung des Omniversums: Wie Open World Foundation Models synthetische Umgebungen zur Förderung der physischen KI erschaffen

Open World Foundation Models im Omniverse: Motoren synthetischer Umgebungen für Physical AI

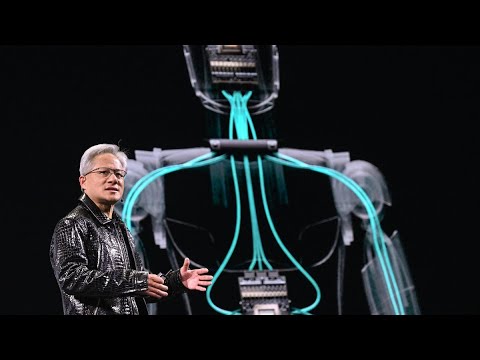

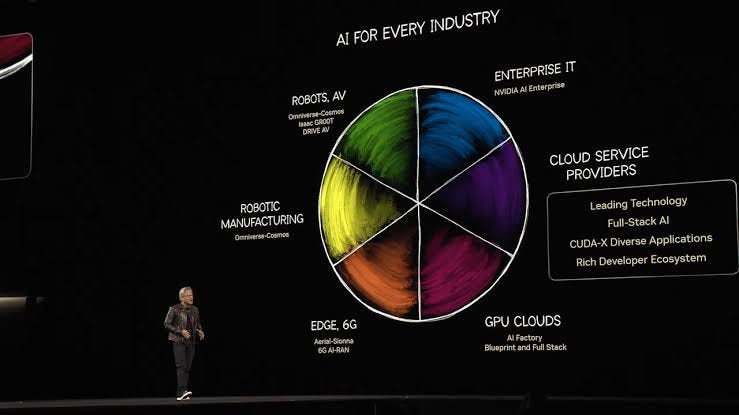

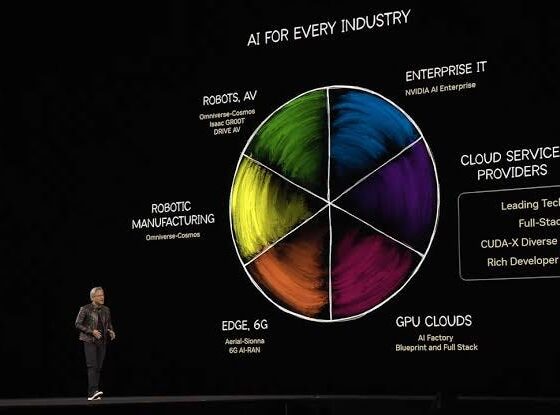

Physical AI—das Software-Gehirn für Roboter, autonome Fahrzeuge, Drohnen und Industriemaschinen—muss unter Unsicherheit über Raum, Zeit und Physik nachdenken. Das Training solcher Systeme erfordert vielfältige, physikalisch fundierte Daten über Wetter, Beleuchtung, Materialien und menschliches Verhalten. Die reale Datenerfassung ist langsam, teuer und manchmal unsicher. Physikalisch basierte synthetische Datengenerierung, angetrieben von NVIDIA Omniverse und Open World Foundation Models (WFMs) wie Cosmos, schließt diese Lücke, indem Umgebungen, Annotationen und Randfälle bedarfsgerecht skaliert werden.

Neueste Fortschritte konsolidieren Welterzeugung und Domänenübertragung zu kohärenten Workflows. Cosmos Predict 2.5 vereinigt Text2World, Image2World und Video2World in einer leichtgewichtigen Architektur, die konsistente, kontrollierbare Multi-Kamera-Video-Welten aus einer Eingabeaufforderung, einem Bild oder einem Clip erzeugt. Zusammen mit Cosmos Transfer 2.5 können Teams das Erscheinungsbild variieren—Wetter, Beleuchtung, Terrain—während sie räumliche Struktur und physikalische Plausibilität bewahren. Das Ergebnis ist eine schnelle Iteration für Wahrnehmung, Planung und Steuerung über weitere Verteilungen hinweg, als dies jeder Feldeinsatz leisten könnte.

Da WFMs auf OpenUSD basieren, können Teams Assets, Materialien und Szenengraphen fließend zwischen Toolchains in Unity, Unreal Engine, ROBLOX und Omniverse verschieben. Konnektoren ermöglichen Kunst- und Engineering-Teams Zusammenarbeit ohne Formatbarrieren, während Physik-Solver Realismus erzwingen. Die Folge ist nicht nur mehr Daten—es sind bessere, repräsentativere Daten, die die Sim-to-Real-Schleife verkürzen.

Ebenso wichtig ist die offene Modelllizenzierung von Cosmos WFMs und deren anpassbarem Reasoning, die Entwicklern präzise Kontrolle über Szenenzusammensetzung und Einschränkungen gibt. Im Gegensatz zu rein generativen Videotools respektieren diese WFMs Geometrie, Dynamik, Sensoren und Beleuchtung und ermöglichen überprüfbare Tests. Für Physical AI zählt die Treue zu Ursache und Wirkung mehr als allein der Stil.

Betrachten Sie ein Logistik-Startup, das einen Gehweg-Lieferroboter baut. Feldstunden erfassen nur typische Tage. Mit einer WFM-Pipeline kann das Team seltene Gefahren instanziieren—gegenlichtstehende Fußgänger, reflektierende Pfützen oder nebelverhangene Scheinwerfer—und dann in großem Maßstab mit pixelgenauer Segmentierung und simuliertem LiDAR annotieren. Der Wahrnehmungsstack des Roboters lernt nicht nur Objekte zu erkennen, sondern physikkonsistente Ergebnisse vorauszuberechnen.

Die branchenübergreifende Nachfrage folgt. Luft- und Raumfahrtprogramme testen autonome Inspektion unter harscher Hangarbeleuchtung. Energieunternehmen simulieren Wartung in Raffinerien um sich bewegende Teams. Städte proben Flotteninteraktionen mit Mikromobilität. Je breiter das Weltmodell, desto stärker die implementierte Policy.

- 🧠 Physik verstehen: Kollisionen, Reibung, Verdeckung und Kontaktdynamik.

- 🌧️ Randfälle erweitern: niedrige Sonnenwinkel, Schneeglimmern, Böen und Sensorausfälle.

- 🎯 Exakte Labels: Segmentierung, Tiefe, Fluss und 3D-Boxen, auf Kameras abgestimmt.

- ⚡ Schnellere Iteration: Bedingungen tauschen ohne Neuaufnahme realer Aufnahmen.

- 🔄 Hybride Workflows: Mischung aus realen Logs und synthetischen Assets für stärkere Generalisierung.

| Datenmodalität 🚀 | Stärken ✅ | Lücken ⚠️ | Beste Verwendung 🔧 |

|---|---|---|---|

| Nur Realwelt | Hohe Authentizität, emergente Komplexität | Spärliche Randfälle, teuer, Sicherheitsrisiken | Benchmarking finaler Policies |

| Nur synthetisch | Unendliche Variation, perfekte Labels, sicher | Potentielle Domänenlücke | Pretraining und Stresstests |

| Hybrid (empfohlen) 🌟 | Das Beste aus beiden Welten, kontrollierte Vielfalt | Erfordert Tool-Integration | Produktionsreife Pipelines |

Während der nächste Abschnitt die Pipeline erklärt, bleibt ein Thema beständig: kontrollierbare Welten sind der schnellste Weg zu robustem Physical AI.

Vom Prompt zur fotorealistischen Welt: Cosmos Predict 2.5 und Transfer 2.5 in der Praxis

Eine reproduzierbare Pipeline ermöglicht es Engineering-Teams, von einer mit dem Telefon aufgenommenen Standortvermessung zu einer weltweiten Simulation mit Kameras, LiDAR und Akteuren zu skalieren. Ein üblicher vierteiliger Ablauf kombiniert Omniverse-Bibliotheken, Isaac-Tools und Cosmos WFMs, um von Referenz zum Trainingssatz zu gelangen.

Reference-to-World-Workflow mit OpenUSD

Beginnen Sie mit der Rekonstruktion der Realität. Mit Omniverse NuRec bauen Teams digitale Zwillinge aus einem Smartphone-Scan auf, was eine metrisch genaue OpenUSD-Szene liefert. Nächstes füllen sie mit SimReady-Assets—physikalisch korrekte Materialien, Rigs und Sensoren, die konsistent über Pfadverfolger und Rasterizer in Unity, Unreal Engine und Omniverse rendern. Dann verwenden sie Isaac Sim MobilityGen, um Trajektorien, Agenten und Verkehrslogik zu inszenieren. Schließlich rufen sie Cosmos Predict 2.5 zur Multiview-Video-Synthese und Cosmos Transfer 2.5 zum Anwenden kontrollierter Erscheinungsbildänderungen auf.

Zwei Upgrades stechen hervor. Erstens konsolidiert Predict 2.5 drei Modelle—Text2World, Image2World, Video2World—so dass ein einzelnes Bild oder kurzer Clip sich zu multi-kameral, zeitkohärenten Sequenzen ausdehnt. Zweitens bietet Transfer 2.5 ein 3,5× kleineres Modell, schnellere Leistung und bessere Prompt-Ausrichtung, während die Szenengeometrie erhalten bleibt. Diese Kombination senkt Kosten und erweitert die Abdeckung.

- 🗺️ NuRec: Einen Standort mit dem Telefon erfassen und Geometrie, Materialien sowie Maßstab rekonstruieren.

- 🧩 SimReady-Assets: Plug-and-Play-3D-Modelle, Sensoren und Rigs für konsistente Physik.

- 🚦 MobilityGen: Verkehrsakteure, Routen und Randfälle wie abgestellte Fahrzeuge.

- 🎥 Cosmos Predict 2.5: Konsistente Multi-Kamera-Videos aus einem Prompt oder einer Referenz.

- 🎨 Cosmos Transfer 2.5: Räumlich bewusster Stiltransfer über Kameras und Zeit.

| Fähigkeit 🧩 | Predict 2.5 🎥 | Transfer 2.5 🎨 | Nutzen 📈 |

|---|---|---|---|

| Eingabetypen | Text, Bild, Video | Welt-zu-Welt | Flexible Autorenschaft |

| Ausgabe | Multi-Kamera, zeitkonsistente Videowelten | Stilveränderte, räumlich getreue Szenen | Datenvielfalt ohne Drift |

| Leistung | Leichtgewichtiges, vereinheitlichtes Modell | 3,5× kleiner als Vorgänger ⚡ | Schnellere Zyklen, geringere TCO |

| Physiktreue | Geometriebewusste Synthese | Erhält Struktur und Einschränkungen | Vertrauenswürdige Bewertung |

Industriedesign-Teams können Fahrzeuge im Sim prototypisieren und dann Aerodynamik, Beleuchtungssensoren und Steuerungsrichtlinien in großem Maßstab validieren. Für tieferen Kontext, wie KI-beschleunigte Physik Engineering-Zyklen neu gestaltet, siehe diese Perspektive zu KI-Physik, die Luft- und Fahrzeugtechnik revolutioniert. Robotikführer können auch erkunden, wie Open-Source-Frameworks für Next-Gen-Robotik die Produktionszeit verkürzen.

Da OpenUSD sauber mit Game Engines und Content-Plattformen kombiniert wird, erweitern Kreative im Epic Games-Ökosystem eine Welt in ROBLOX für synthetische Interaktionsdaten und bringen die Assets dann zurück in Robotersimulationen. Dieselben Assets können von Reinforcement-Learning-Stacks von OpenAI, Meta AI und Microsoft Research genutzt werden, während die Sicherheitsbewertung Forschungsprotokollen folgt, die von Google DeepMind und historischen DeepMind-Papieren zur Generalisierung bei Verteilungsverschiebung inspiriert sind.

Wenn die Pipeline vorgefertigt ist, werden neue Standorte und Szenarien zu einem wiederholbaren Knopfdruck. Das zentrale Muster ist einfach: referenzieren → komponieren → generieren → variieren → evaluieren.

Fallstudien: Skild AI, Serve Robotics und Zipline schließen die Sim-to-Real-Lücke

Praktiker beweisen bereits den Wert von WFM-gesteuerten synthetischen Daten. Betrachten Sie drei Einsätze, bei denen Skalierung, Kontrolle und Physikbewusstsein direkt in den Betrieb übersetzt werden.

Allzweck-Roboterhirne bei Skild AI

Skild AI nutzt Isaac Lab, um skalierbare Trainingsfarmen über Robotereinsätze und Aufgaben zu bauen. Mit Cosmos Transfer erweitert das Team begrenzte reale Aufnahmen um neue Beleuchtung, Wetter und Texturen, um Policies vor Hardwaretests zu stresstesten. Das Ergebnis ist schnellere Übertragung auf reale Plattformen und weniger Feldstunden—kein kleiner Gewinn, wenn jeder Versuch Sicherheitsteams und Ausfallchecks erfordert.

Serve Robotics: Urbane Autonomie in großem Maßstab

Serve Robotics trainiert an Tausenden von NVIDIA Isaac Sim-Szenarien und mischt synthetische mit realen Logs. Das Unternehmen betreibt eine der größten autonomen Roboterflotten im öffentlichen Raum und hat über 100.000 Lieferungen in urbanen Blöcken erreicht. Ihre Roboter sammeln monatlich etwa 1 Million Meilen und fast 170 Milliarden Bild-LiDAR-Datenpunkte. Diese Daten fließen zurück in Simulationen, wo Randfälle abgespielt und erweitert werden, was sicherere Navigation in dicht besiedelten Gegenden ermöglicht.

Über Essen hinaus lieferte Serve kürzlich Rechenleistung—Übergabe von DGX Spark persönlichen KI-Supercomputern an Kreative wie Refik Anadol und Will.I.AM sowie Plattformteams bei Ollama. Mit etwa 1 PFLOP KI-Leistung ermöglicht DGX Spark On-Desk-Feinabstimmung, Inferenz und Robotikentwicklung—beschleunigt die Schleife vom Konzept zur Umsetzung. Für einen breiteren Branchenüberblick siehe diese Analyse, wie KI-Physik Engineering-Workflows beschleunigt.

Zipline: Edge AI mit Fluggeschwindigkeit

Zipline setzt auf die NVIDIA Jetson Edge-KI- und Robotikplattform für Drohnenlieferungen. Eine aktuelle DGX-Spark-Übergabe an das Half Moon Bay-Werk von Zipline unterstreicht, wie Cloud-to-Edge-Synergien zählen: intensives Training in Rechenzentren; schnelle sim-basierte Validierung mit Cosmos; kompakte Jetson-Inferenz im Feld. Weltmodelle helfen, komplexe Aerodynamik von Vorstadtkorridoren—Baumkronen, Stromleitungen, Windscherung—ohne Risiko für Fluggeräte zu codieren.

- 🚚 Serve Robotics: städtische Beinahe-Unfälle wiedergeben und seltene Randfälle skalieren.

- 🛩️ Zipline: Korridorwinde, Verdeckungen und Beleuchtungswechsel simulieren.

- 🤖 Skild AI: Richtlinien-Training über Arme, Räder und Bipeden vereinheitlichen.

- 🧱 Cosmos Transfer: Variation erweitern bei Erhalt der Geometrie.

- 🧪 Isaac Lab/Sim: standardisierte, wiederholbare Experimentgerüste.

| Organisation 🏢 | Schlüsseltools 🧰 | Skalenmetriken 📊 | Ergebnis 🎯 |

|---|---|---|---|

| Serve Robotics | Isaac Sim + Cosmos | 100k+ Lieferungen; 1 Mio. Meilen/Monat; 170 Mrd. Samples | Sichere urbane Autonomie 🚦 |

| Skild AI | Isaac Lab + Cosmos Transfer | Trainieren über verschiedene Embodiments | Schneller Sim-to-Real-Transfer ⏩ |

| Zipline | Jetson + Cosmos + DGX Spark | Hochfrequente Flugvalidierung | Zuverlässige Edge-Inferenz ✈️ |

Diese Fallstudien spiegeln ein breiteres Muster wider: breit simulieren, präzise validieren, verlässlich einsetzen. Teams, die offene Komponenten evaluieren, sollten einen Überblick zu offenen Frameworks zur Beschleunigung der Robotik-Innovation zu Rate ziehen.

Datenvielfalt in Industriequalität: Lightwheel, FS Studio und Bergbaubetrieb im großen Stil

WFM-Pipelines wirken sich nicht nur auf Autonomie aus, sondern auf jeden Workflow, in dem Wahrnehmung und Steuerung auf schwer erhältlichen Labels und seltenen Fehlerfällen basieren. Mehrere Einsätze zeigen, wie Domänenexperten synthetische Daten zu messbaren Ergebnissen einsetzen.

Lightwheel: Simulation zuerst, OpenUSD im Kern

Lightwheel hilft Herstellern, die Sim-to-Real-Lücke mit SimReady-Assets und groß angelegten synthetischen Datensätzen zu überbrücken. Basierend auf OpenUSD replizieren Lightwheels Umgebungen Asset-Materialien, Sensormodelle und Fabrikfloordynamik. In diesen Welten trainierte Roboter verhalten sich während der Inbetriebnahme vorhersehbarer, reduzieren Ausfallzeiten und MTTR. Da Assets portabel sind, können dieselben Modelle in Unity, Unreal Engine und NVIDIA Omniverse-Renderern stresserprobt werden und früh Randfälle erfassen.

Bergbau: Felsblockerkennung und Kosteneinsparung

Omniverse-Community-Mitglied Santiago Villa nutzt synthetische Daten, um große Felsbrocken vor Verstopfen von Brechern zu erkennen. Jedes nicht entdeckte Ereignis kann die Abläufe um sieben Minuten oder mehr verzögern und bis zu 650.000 $ jährlich an verlorener Durchsatzleistung kosten. Durch Tausende automatisch annotierter Bilder bei unterschiedlicher Beleuchtung und Wetter verbessern Bergbaubetreiber die Trefferquote und halten die Labelkosten niedrig. Die Folge sind weniger Stillstände, geringerer Verschleiß und sicherere Arbeitsbereiche.

FS Studio: Logistik-Durchsatzsteigerung

In Partnerschaft mit einem globalen Logistikführer erzeugte FS Studio Tausende fotorealistischer Paketvarianten mit Omniverse Replicator. Das Training an diesem Datensatz verbesserte Objektgenauigkeit und verringerte Fehlalarme—was direkt die Bandgeschwindigkeit und den Systemdurchsatz steigerte. Ein ähnlicher Ansatz kann ROBLOX</strong-artige Interaktionsdaten für menschen-roboter-Ko-Navigation prüfen und zurück in Omniverse für Sicherheitstests portieren, wodurch Konsumentenrealismus für Industrieszenarien entsteht.

Robots for Humanity und Scott Dempsey: Tiefe Teleoperation und Bauteilhandling

Robots for Humanity baute eine vollständige Isaac Sim-Umgebung für Öl und Gas, die RGB, Tiefe und Segmentierung generiert und Unitree G1-Gelenkdaten via Teleoperation erfasst. Scott Dempsey entwickelte einen Kabelsynthesizer, der Varianten aus Herstellerspezifikationen erzeugt und Trainingssätze mit Cosmos Transfer erweitert, um Kabelerkennung und -manipulation zu verbessern. Beide Projekte betonen das Prinzip: Struktur zählt. Wenn sich das Erscheinungsbild ändert, aber die Geometrie intakt bleibt, generalisieren Modelle ohne Kalibrierungsverlust.

- 🏭 OpenUSD-Portabilität: ein Szenengraph, viele Renderer und Engines.

- 🧪 Wiederholbare Experimente: deterministische Seeds für faire A/B-Tests.

- 📦 Domänenvielfalt: Logistik, Bergbau, Energie und Einzelhandel im selben Framework.

- 🧵 Fein granulare Variation: Materialien, Kabel, Barcodes und Paletten-Texturen.

- 🛡️ Sicherheit vor Feldbetrieb: virtuelle Proben für risikoreiche Aufgaben.

| Anwendungsfall 🛠️ | Tools 🔌 | Metrik/Impact 📈 | Hinweise 🧭 |

|---|---|---|---|

| Boulder-Erkennung im Bergbau | Omniverse + synthetische Bilder | Bis zu 650k $/Jahr eingespart | Unterschiedliche Beleuchtung und Wetter 🌦️ |

| Paketdetektion in der Logistik | Replicator + SimReady | Höhere Präzision, weniger Fehlalarme | Durchsatz- und Bandgeschwindigkeitsgewinne 🚚 |

| Kabelmanipulation | Isaac Sim + Cosmos Transfer | Verbesserter Greif-Erfolg | Herstellerspezifikationen-Synthesizer 🧵 |

| Teleop-Policy-Lernen | Isaac Sim + Unitree G1 | Verbesserte Sim-to-Real-Stabilität | Tiefen- und Segmentierungstraining 🧩 |

Diese Einsätze zeigen eine gemeinsame Lehre: physikkonsistente Variation liefert nachhaltige Gewinne, wenn sie mit rigoroser Bewertung kombiniert wird.

Das Zusammenwachsen des Ökosystems: OpenUSD, Omniverse und Forschungspartner formen Physical AI

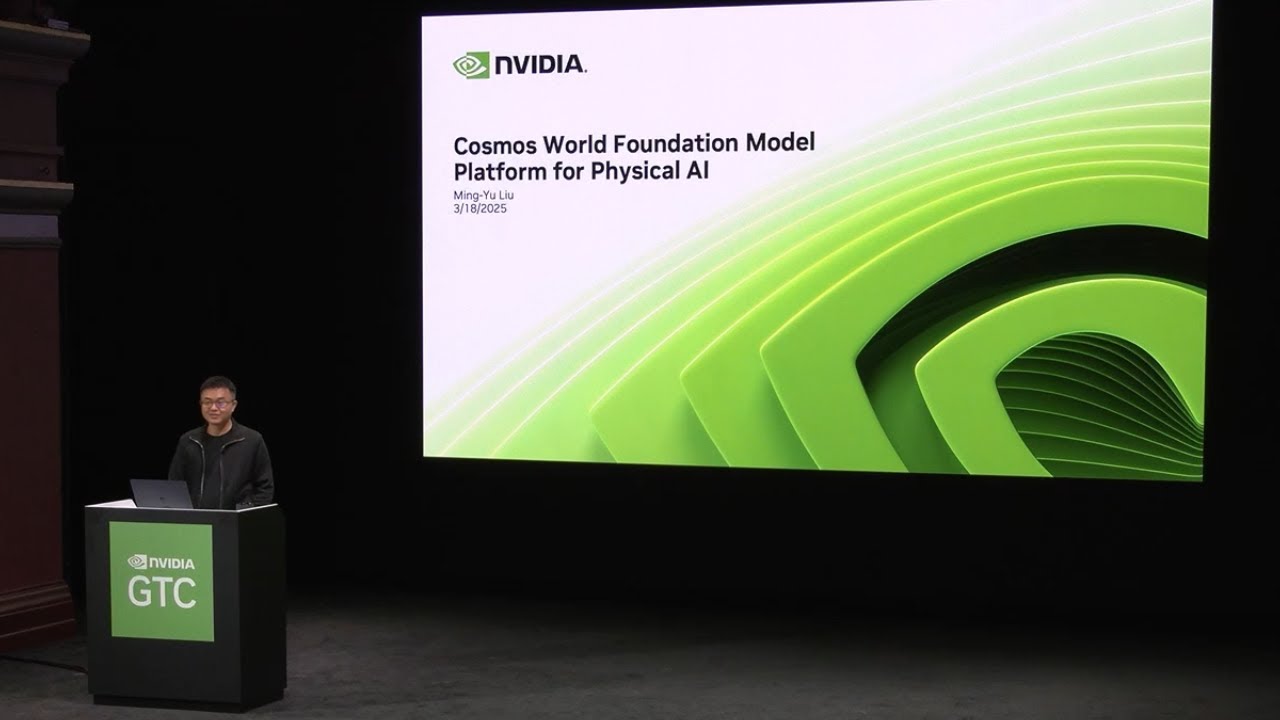

Physical AI gedeiht dort, wo Inhalt, Simulation und Forschung zusammenkommen. Die kürzliche Veröffentlichung von Cosmos World Foundation Models—vorgestellt neben Omniverse-Fortschritten auf branchenführenden Events—signalisiert eine Verschiebung hin zu offenem, anpassbarem Reasoning für Welterzeugung. Auf Millionen Stunden Robotik- und Fahrvideos trainiert, bieten diese WFMs Entwicklern beispiellose Kontrolle über Szenenzusammensetzung unter Beachtung der Physik.

Forschungsgruppen von OpenAI, Microsoft Research, Meta AI und Google DeepMind erkunden weiterhin Generalisierung, Planung und agentenbasierte Stacks, die von kontrollierbaren synthetischen Welten profitieren. Methoden wie Curricula, Domänenrandomisierung und Systemidentifikation werden effektiver, wenn Szenarien mit konsistenten Materialien, Sensoren und Dynamiken gerendert werden. Historische DeepMind-Arbeit zur Verteilungsverschiebung unterstreicht, warum Reproduzierbarkeit—mit gesetzten Seeds und nachvollziehbaren Prompts—zentral für Bewertungen sein muss.

Toolchain-Verschmelzung hilft Teams, Content-Plattformen mit Simulation und Training zu integrieren. Unity und Unreal Engine bedienen weiterhin Echtzeit-Autorenschaft, Epic Games erweitert High-Fidelity-Workflows, und ROBLOX steuert soziale Interaktionsdynamiken für HRI bei. Mit OpenUSD als gemeinsamer Grundlage wandern Assets über Ökosysteme ohne Semantikverlust, während NVIDIA Omniverse Rendering, Sensorsimulation und Weltlogik koordiniert.

Industrieakteure wenden diese Muster bereits bei digitalen Fabriken und Robotikzwillingen an. Omniverse-„Mega Factory“- und Robotikzwilling-Blaupausen zeigen, wie man Flotten-Simulatoren mit Standardteilen konfiguriert. Für Einsteiger gibt es praxisorientierte Guides und Referenz-Workflows, die dann mit WFMs für Datenvielfalt ergänzt werden. Ein ergänzender Überblick zu Open-Source-Roboterframeworks passt gut zu diesem Beitrag über KI-gestützte Engineering-Beschleunigung.

- 📚 Schnell lernen: Einstieg mit Isaac Sim-Pfaden für ROS 2, Sensoren und Daten.

- 🧪 Referenz-Workflows: Generative KI-Pipelines zur synthetischen Datengenerierung.

- 🍳 Cosmos Cookbook: Schritt-für-Schritt-Rezepte für WFM-Prompts, Steuerung und Bewertung.

- 📱 Phone-to-Twin: Aufnahme eines Standorts mit iPhone und Rekonstruktion in Isaac Sim.

- ☁️ NVIDIA Brev: Vorgefertigte GPU-Umgebungen für Experimente mit Physical AI.

| Akteur 🌐 | Beitrag 🔬 | Schnittstelle 🔗 | Auswirkung 💥 |

|---|---|---|---|

| NVIDIA Omniverse | Rendering, Sensorsimulation, digitale Zwillinge | OpenUSD-Konnektoren | Fotorealistische, physikbewusste Daten |

| Cosmos WFMs | Welterzeugung + Stiltransfer | Predict 2.5, Transfer 2.5 | Vielfalt mit struktureller Treue 🌉 |

| OpenAI / Google DeepMind | Planungs- und Generalisierungsforschung | RL, modellbasierte Steuerung | Robustes Policy-Lernen 🧭 |

| Unity / Unreal Engine | Echtzeit-Autorenschaft und Interaktivität | Engine-Konnektoren | Schnellere Inhaltserstellung ⚙️ |

| ROBLOX / Epic Games | Soziale und hochrealistische Dynamiken | USD-Import/Export | Mensch-in-der-Schleife HRI 🤝 |

Während sich diese Ökosysteme angleichen, fällt eine Erkenntnis besonders auf: offene, physikalisch genaue und kontrollierbare Welten sind der universelle Nährboden für Physical AI Forschung und Einsatz.

Ein wiederholbares synthetisches Datenprogramm aufbauen: Metriken, Governance und Roadmaps

Der Aufbau einer dauerhaften Praxis für synthetische Daten erfordert mehr als kreative Prompts. Teams brauchen KPIs, Governance und Iterationszyklen, die Welterzeugung an Sicherheits- und Produktivitätszielen ausrichten. Ein praktischer Fahrplan unterstützt die Skalierung von Machbarkeitsstudien zu Unternehmensstandards.

Relevante Metriken

Über Mean Average Precision oder Streckenvollendung hinaus sollten Organisationen Abdeckung der Umweltbedingungen, Entdeckungsrate von Fehlerfällen und Sim-to-Real-Differenzen für Schlüsselaufgaben messen. Üblich ist, Verteilungen—Beleuchtung, Wetter, Materialien, Verdeckungen—in Buckets zu sortieren und pro Release Zielabdeckung sicherzustellen. Cosmos Transfer erleichtert das „Ausfüllen“ unterrepräsentierter Zellen, ohne Geometrie oder Kalibrierung zu beschädigen.

Governance und Prüfbarkeit

Mit der Einführung mächtiger generativer Steuerungen durch WFMs werden Audit-Trails unverzichtbar. Protokollieren Sie Prompts, Seeds, Asset-Versionen und Engine-Einstellungen. Bewahren Sie OpenUSD-Szenen-Unterschiede zur Dokumentation aller Änderungen auf. Das ist besonders wichtig in regulierten Bereichen—Luftfahrt, Gesundheitsrobotik, Energie—wo Reproduzierbarkeit und Rückverfolgbarkeit Grundlage für Zertifizierungen sind.

Roadmap: Vom Pilot zur Produktion

Ein wirksamer Plan startet klein—ein Standort, ein Roboter, Seed-Abdeckung—und skaliert horizontal. Verknüpfen Sie synthetische Szenarien mit realen Vorfällen: jeder Beinahe-Unfall wird zu einer vorlagenbasierten Szenarienfamilie. Pflegen Sie über die Zeit einen Weltkatalog, indexiert nach Gefahren, Materialien und Sensoren. Aktualisieren Sie periodisch das Erscheinungsbild mit Cosmos Transfer, um Überanpassung an einen einzigen Look zu vermeiden.

- 🧭 Verteilungen definieren: Beleuchtung, Wetter, Materialien und Verkehrsdichte.

- 🧱 Fehlerfälle vorlagenbasiert: Blendung, Verdeckung, Pfützen, reflektierende Böden.

- 🗂️ Weltbibliothek kuratieren: getaggt nach Aufgabe, Sensor und Risiko.

- 🔍 Sim-to-Real-Differenz verfolgen: Drift bewerten und nachkalibrieren.

- 🤖 Regression automatisieren: geplante Szenarienwiederholungen nach jedem Modellupdate.

| Phase 🛤️ | Fokussierung 🎯 | Tools 🔧 | Meilenstein 🏁 |

|---|---|---|---|

| Pilot | Ein Standort, ein Roboter, Seed-Abdeckung | NuRec + SimReady + Predict 2.5 | Baselinesimulation-zu-Real-Lücke |

| Expansion | Randfälle und Stresstests | MobilityGen + Transfer 2.5 | Abdeckungsziele erreicht 📊 |

| Produktion | Governance und Automatisierung | USD-Diffs + CI/CD + Dashboards | Geprüfte Releases und Sicherheitstore 🔐 |

Unternehmen, die Plattformen evaluieren, können vertiefende Analysen zu offenen Frameworks für Robotik-Pipelines und Branchenanalysen zu KI-Physik zur Engineering-Beschleunigung konsultieren. Das Ergebnis eines disziplinierten Programms ist konsistent: weniger Rückschritte, schnellere Releases, sicherere Einsätze.

{“@context”:”https://schema.org”,”@type”:”FAQPage”,”mainEntity”:[{“@type”:”Question”,”name”:”Wie reduzieren Cosmos World Foundation Models die Sim-to-Real-Lücke?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Cosmos Predict 2.5 erzeugt zeitkonsistente, multi-kameral Welten, die Geometrie und Sensorbeschränkungen respektieren, während Cosmos Transfer 2.5 Erscheinung (Wetter, Beleuchtung, Materialien) variiert, ohne die räumliche Struktur zu zerstören. Dies ermöglicht eine breitere Trainingsabdeckung mit physikalischer Plausibilität und verbessert die Generalisierung in der realen Welt.”}},{“@type”:”Question”,”name”:”Können Teams Unity- oder Unreal Engine-Assets mit Omniverse und OpenUSD mischen?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Ja. OpenUSD-Konnektoren ermöglichen es, Assets, Materialien und Szenengraphen zwischen Unity, Unreal Engine, ROBLOX und NVIDIA Omniverse zu verschieben. Dies bewahrt Semantik und physikalische Eigenschaften, so dass Inhalte von verschiedenen Renderern und Simulatoren verwendet werden können.”}},{“@type”:”Question”,”name”:”Welche KPIs sollten ein synthetisches Datenprogramm steuern?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Verfolgen Sie die Abdeckung von Umweltverteilungen, Entdeckungsraten von Fehlerfällen und Sim-to-Real-Differenzen für Schlüsselaufgaben. Beziehen Sie Präzision/Rückruf, Interventionsraten und Sicherheitsmetriken ein. Führen Sie Audit-Trails für Prompts, Seeds und OpenUSD-Szenenunterschiede.”}},{“@type”:”Question”,”name”:”Wo passen reale Logs in eine WFM-Pipeline?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Reale Logs dienen als Ausgangspunkt für den Weltaufbau (via NuRec), liefern seltene Verhaltensweisen und fungieren als endgültiger Evaluierungsmaßstab. Synthetische Welten schließen Abdeckungslücken, bieten perfekte Labels und ermöglichen sichere Stresstests. Eine Hybridlösung aus beiden wird empfohlen.”}},{“@type”:”Question”,”name”:”Wie profitieren Forschungslabore wie Google DeepMind oder OpenAI von kontrollierbaren Welten?”,”acceptedAnswer”:{“@type”:”Answer”,”text”:”Kontrollierbare Welten ermöglichen rigorose Bewertung unter Verteilungsverschiebung, Curriculum-Lernen und agentenbasierte Planungsforschung. Reproduzierbare Prompts und Seeds helfen, kausale Faktoren zu isolieren, was Einsichten beschleunigt und Störeinflüsse reduziert.”}}]}Wie reduzieren Cosmos World Foundation Models die Sim-to-Real-Lücke?

Cosmos Predict 2.5 erzeugt zeitkonsistente, multi-kameral Welten, die Geometrie und Sensorbeschränkungen respektieren, während Cosmos Transfer 2.5 Erscheinung (Wetter, Beleuchtung, Materialien) variiert, ohne die räumliche Struktur zu zerstören. Dies ermöglicht eine breitere Trainingsabdeckung mit physikalischer Plausibilität und verbessert die Generalisierung in der realen Welt.

Können Teams Unity- oder Unreal Engine-Assets mit Omniverse und OpenUSD mischen?

Ja. OpenUSD-Konnektoren ermöglichen es, Assets, Materialien und Szenengraphen zwischen Unity, Unreal Engine, ROBLOX und NVIDIA Omniverse zu verschieben. Dies bewahrt Semantik und physikalische Eigenschaften, so dass Inhalte von verschiedenen Renderern und Simulatoren verwendet werden können.

Welche KPIs sollten ein synthetisches Datenprogramm steuern?

Verfolgen Sie die Abdeckung von Umweltverteilungen, Entdeckungsraten von Fehlerfällen und Sim-to-Real-Differenzen für Schlüsselaufgaben. Beziehen Sie Präzision/Rückruf, Interventionsraten und Sicherheitsmetriken ein. Führen Sie Audit-Trails für Prompts, Seeds und OpenUSD-Szenenunterschiede.

Wo passen reale Logs in eine WFM-Pipeline?

Reale Logs dienen als Ausgangspunkt für den Weltaufbau (via NuRec), liefern seltene Verhaltensweisen und fungieren als endgültiger Evaluierungsmaßstab. Synthetische Welten schließen Abdeckungslücken, bieten perfekte Labels und ermöglichen sichere Stresstests. Eine Hybridlösung aus beiden wird empfohlen.

Wie profitieren Forschungslabore wie Google DeepMind oder OpenAI von kontrollierbaren Welten?

Kontrollierbare Welten ermöglichen rigorose Bewertung unter Verteilungsverschiebung, Curriculum-Lernen und agentenbasierte Planungsforschung. Reproduzierbare Prompts und Seeds helfen, kausale Faktoren zu isolieren, was Einsichten beschleunigt und Störeinflüsse reduziert.

-

Open Ai1 week ago

Open Ai1 week agoEntfesselung der Power von ChatGPT-Plugins: Verbessern Sie Ihr Erlebnis im Jahr 2025

-

Open Ai6 days ago

Open Ai6 days agoMastering GPT Fine-Tuning: Ein Leitfaden zur effektiven Anpassung Ihrer Modelle im Jahr 2025

-

Open Ai7 days ago

Open Ai7 days agoVergleich von OpenAIs ChatGPT, Anthropics Claude und Googles Bard: Welches generative KI-Tool wird 2025 die Vorherrschaft erlangen?

-

Open Ai6 days ago

Open Ai6 days agoChatGPT-Preise im Jahr 2025: Alles, was Sie über Tarife und Abonnements wissen müssen

-

Open Ai7 days ago

Open Ai7 days agoDas Auslaufen der GPT-Modelle: Was Nutzer im Jahr 2025 erwartet

-

KI-Modelle6 days ago

KI-Modelle6 days agoGPT-4-Modelle: Wie Künstliche Intelligenz das Jahr 2025 verändert